当前位置:网站首页>Week 6 Linear Models for Classification (Part B)

Week 6 Linear Models for Classification (Part B)

2022-07-28 19:46:00 【金州饿霸】

目录

一、概率生成模型(Probabilistic Generative Models)- 分类问题转化为概率问题

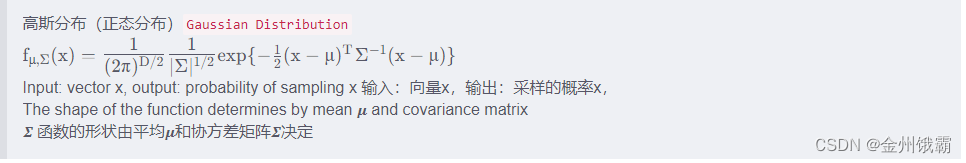

2、高斯分布(正态分布)Gaussian Distribution

二、概率判别模型(Probabilistic Discriminative Models)

三、Discriminative 和 generative models的区别

四、Logistic Regression和Linear Regression区别与联系

一、概率生成模型(Probabilistic Generative Models)- 分类问题转化为概率问题

1、什么是Generative Model

将两个盒子看作两个类别:

class 1,class 2.

抽取的小球可以看作待分类的数据

想要得到数据的分类,类比盒子抽球的模型:

当抽到数据x时

它是从class 1 得到的概率为:

它是从class 2 得到的概率为:

通过计算某个数据属于不同class的概率,若数据属于某个class的概率最大,则可以将数据分类为这个类别。

因此,只要知道以下数值特征,即可对数据进行分类:

: 数据属于

: 数据属于Class 1的概率可以通过训练集中class 1 的占比表示

: 数据属于

: 数据属于Class 2的概率可以通过训练集中class 2的占比表示

:

: class 1中得到 x的概率

:

:class 2中得到 x 的概率

这种思路叫做生成模型Generative Model。因为有了这个模型,就可以生成一个 x,可以计算某个 x 出现的概率,知道了x的分布,就可以自己产生 x 。

2、高斯分布(正态分布)Gaussian Distribution

使用极大似然估计法Maximum Likelihood找出高斯分布:

似然函数:

计算方法:

得到了期望向量和协方差矩阵,就确定了高斯分布的模型,接下来可以进行分类了。

其中P ( C 1 ) 和P ( C 2 ) 通过占比计算:

如果 * x belongs to class 1 ,如果x来自于class 1的概率大于0.5,可以认为x属于class 1。

* x belongs to class 1 ,如果x来自于class 1的概率大于0.5,可以认为x属于class 1。

但是,考虑了两种特征,在测试集上的正确率仅有47%,考虑了所有特征后,正确率仅有54%。于是我们进行改进模型,假设生成的概率模型满足两个类别的协方差矩阵的值相等。

- 极大似然函数为:

- 计算方法:

和

和 和之前一样

和之前一样

通过

通过  和

和  的加权平均来计算:

的加权平均来计算:

- 概率模型的说明

3、概率生成模型的三步

4、概率生成模型的数学推导(重点)

- Posterior Probability后验概率(也叫Decision Boundary):事情还没有发生,要求这件事情发生的可能性的大小,是先验概率。事情已经发生,要求这件事情发生的原因是由某个因素引起的可能性的大小,是后验概率。

- 数学推导1:后验概率化为z的函数

- 数学推导2:z的化简

其中:

得到后验概率的表达式:(也叫决策边界,大于0.5,归为C1类,反之归于C2类)

二、概率判别模型(Probabilistic Discriminative Models)

1、Logistic Regression

- 逻辑回归属于probabilistic discriminative model这一类的分类算法。

probabilistic discriminative mode这类算法的思路如下:

- 直接建模

- 利用最大似然估计和训练数据,估计出模型中的参数

该类想法相对于生成模型(probabilistic generated model) 有参数较少的优点。因为生成模型需要 和先验概率

和先验概率 。

。

LR是工业界最长用的分类算法之一,其主要原因,个人认为有几点如下:

- 训练速度快,扛得住大数据

- 模型可解释度、可理解程度高,根据每个特征的系数,就可以判断出该特征在模型中的重要性,帮助判断模型是否合理

- 可以接受的精度

2、LR二分类

3、LR多分类

SGD更新w:

三、Discriminative 和 generative models的区别

四、Logistic Regression和Linear Regression区别与联系

1、Logistic Regression

- 应用于分类问题

- 除了可以解决二分类问题外,还可以解决多分类问题。

- Logistic Regression 是离散的。例如预测明天天气-阴,晴,雨。分类问题是用于将事物打上一个标签,通常结果为离散值。例如判断一幅图片上的动物是一只猫还是一只狗,分类通常是建立在回归之上,分类的最后一层通常要使用softmax函数进行判断其所属类别。分类并没有逼近的概念,最终正确结果只有一个,错误的就是错误的,不会有相近的概念。最常见的分类方法是逻辑回归,或者叫逻辑分类。

- Logistics Regression仍然属于线性回归的范畴,因为分界面是线性的,而且Logistics Regression是广义线性模型(GLM)或者叫对数线性模型(LLM);

- Logistics Regression则取对数似然的最大,做梯度下降往正梯度方向,但有时为了与线性回归保持一致,通常会取负对数似然;

- 一般而言,LR指的是Logistics Regression,而非Linear Regression;

- Logistics Regression与Softmax Regression是真正做分类的首选,由于方法简单,易于实现,效果良好,易于解释,除了用于分类,还可以用于推荐系统;

- 激活函数是 sigmoid 函数,可理解成一个被 sigmoid 函数归一化后的线性回归,sigmoid 函数把实数映射到了 [0,1] 区间。关于 Logistic 回归的参数估计求解,在此不详说。如果要预测一个未知数据 x 属于哪个类,只需要带入 sigmoid 假设函数,最简单的决策方法,如果其值在 0.5~1 之间,属于类别 1,反之属于类别 0。

- 采用 Logistic Regression进行多分类的思路是:选取某个分类作为正样本,其他分类作为负样本建立一个二分类模型;以此类推建立多个(有几个分类就建几个)二分类模型;对多个二分类模型的输出值进行大小比较,把样例归为输出值最大的那类。

- Logistic Regression 从本质来说属于二分类问题,是基于Sigmoid函数(又叫“S型函数”)的有监督二类分类模型。

Sigmoid函数公式为:

其导数形式为:

2、Linear Regression

- 解决回归问题,通常是用来预测一个值。如预测房价、未来的天气情况等等,例如一个产品的实际价格为500元,通过回归分析预测值为499元,我们认为这是一个比较好的回归分析。回归是对真实值的一种逼近预测。

- 可以对样本是非线性的,但只要对参数是线性的,就可以使用。其表达形式为y = w'x+e,e为误差服从均值为0的正态分布。对于x是否是线性无所谓,但是需要有时候做特征选择;

- Linear Regression取对数似然的最小,所以在做梯度下降时,往负梯度方向;

3、 二者应用不同

一般Linear Regression是解决回归问题,而 Logistic Regression是应用于分类问题。

Logistic Regression除了可以解决二分类问题外,还可以解决多分类问题。

采用 Logistic Regression进行多分类的思路是:选取某个分类作为正样本,其他分类作为负样本建立一个二分类模型;以此类推建立多个(有几个分类就建几个)二分类模型;对多个二分类模型的输出值进行大小比较,把样例归为输出值最大的那类。

4、二者的代价函数不同

Linear Regression的代价函数为:

Logistic Regression的代价函数为:

原因:二者的模型不同导致二者的代价函数不同

这二者的代价函数不同,是因为定义的H假设不同,也就是模型不同(废话!一个是线性回归,一个是logistic回归,这就是两个模型怎么会相同)。接下来让我们来回顾一个各自的模型。

- Linear Regression的模型为:

- Logistic Regression的模型为:

边栏推荐

- 苹果M1处理器详解:性能及能效成倍提升,Intel酷睿i9也不是对手!

- MySQL sorts out the review content -- with mind map

- 【Bluetooth蓝牙开发】八、BLE协议之传输层

- Kubeadm搭建kubernetes集群

- Learning typescript (II)

- Two excellent software of my love cracking, batch search text, image and video image quality enhancement

- 1945. 字符串转化后的各位数字之和

- 证券企业基于容器化 PaaS 平台的 DevOps 规划建设 29 个典型问题总结

- Nacos 原理

- Jiuxin intelligence officially joined opengauss community

猜你喜欢

How to build a foreign environment for the self-supporting number of express evaluation? How much does it cost?

Kubedm builds kubernetes cluster

SQL Server 数据库之备份和恢复数据库

Study and use of cobalt strike

探讨:想要落地DevOps的话,只考虑好的PaaS容器平台就够了么?

Mobilevit: challenge the end-to-side overlord of mobilenet

九鑫智能正式加入openGauss社区

How NPM switches Taobao source images

属性基加密仿真及代码实现(CP-ABE)论文:Ciphertext-Policy Attribute-Based Encryption

如何度量软件架构

随机推荐

Analysis of critical path

High salary in the workplace | "intermediate and advanced test" interview questions

1162. 地图分析-非递归法

Learning typescript (II)

SQL server中提示对象名无效

Uncaught Error:Invalid geoJson format Cannot read property ‘length‘ of undefind

ctfshow 网络迷踪做题记录(1)

protobuf 中基础数据类型的读写

证券企业基于容器化 PaaS 平台的 DevOps 规划建设 29 个典型问题总结

Backup and recovery of SQL Server database

Coding with these 16 naming rules can save you more than half of your comments!

Efficientformer: lightweight vit backbone

云安全核心技术

Confession of a graduate student: why am I addicted to opengauss community?

分页功能(板子)

属性基加密仿真及代码实现(CP-ABE)论文:Ciphertext-Policy Attribute-Based Encryption

Study - Summary of geometric calculations

关键路径的分析

Buuctf questions upload labs record pass-01~pass-10

到底为什么不建议使用SELECT * ?

和

和 和之前一样

和之前一样 通过

通过  和

和  的加权平均来计算:

的加权平均来计算: