当前位置:网站首页>搭建Spark开发环境

搭建Spark开发环境

2022-08-02 14:17:00 【发量不足】

实验报告

①.spark集群基础

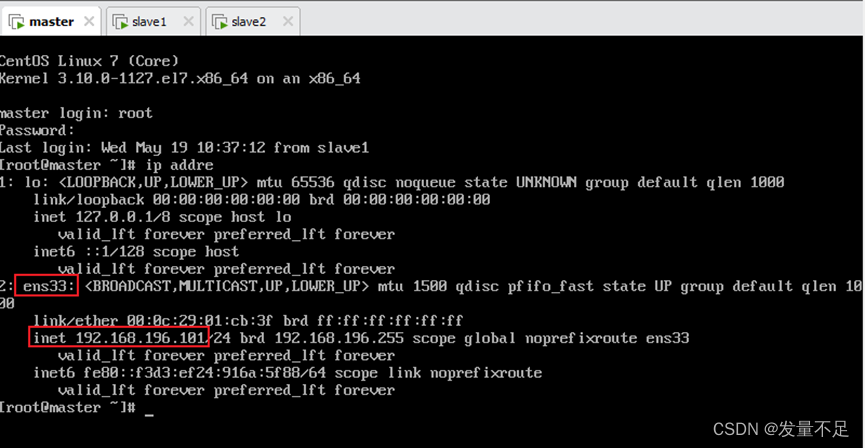

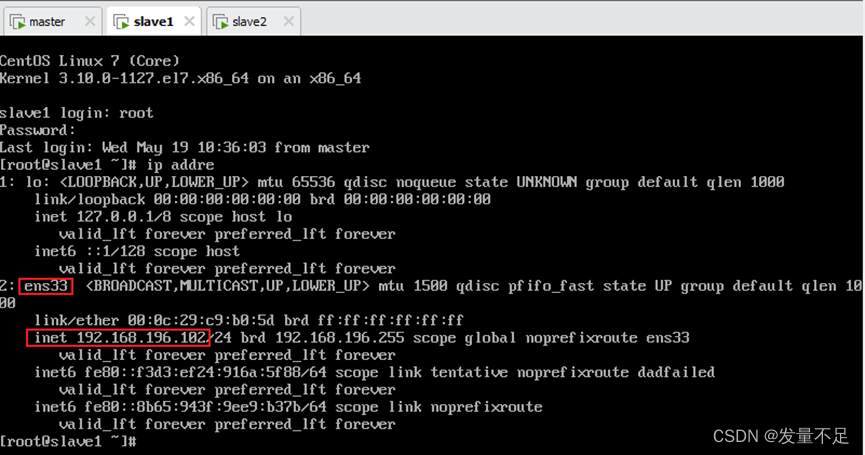

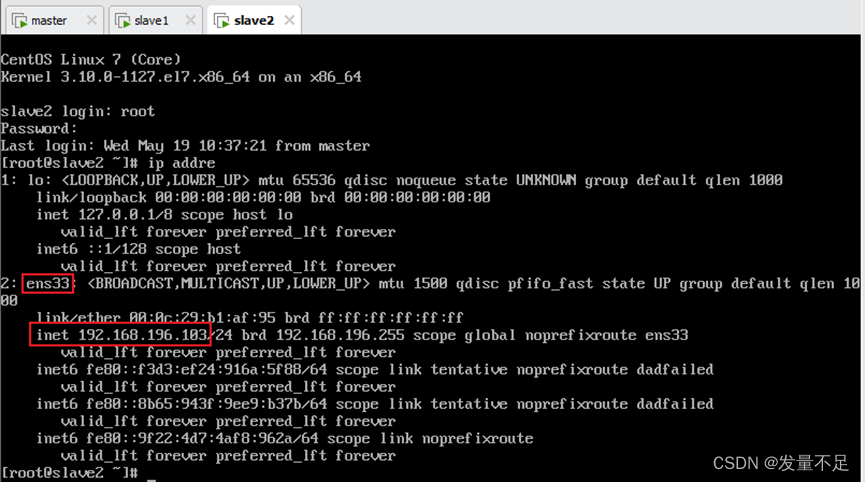

查看自己三个节点环境的ip地址:ip addre

Master:

Slave1:

Slave2:

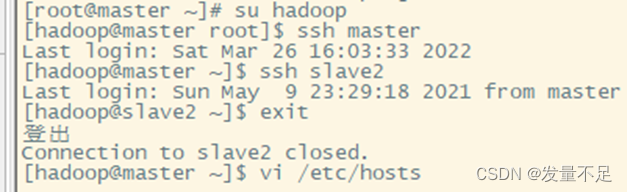

切换hadoop用户查看master能否切换另外两台slave然后配置另外两台可以自由切换

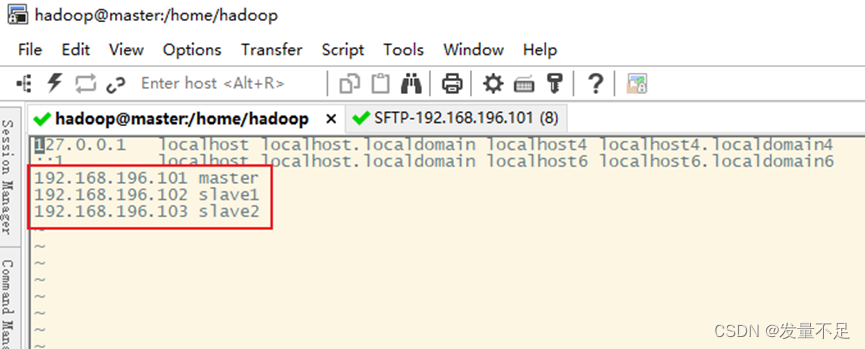

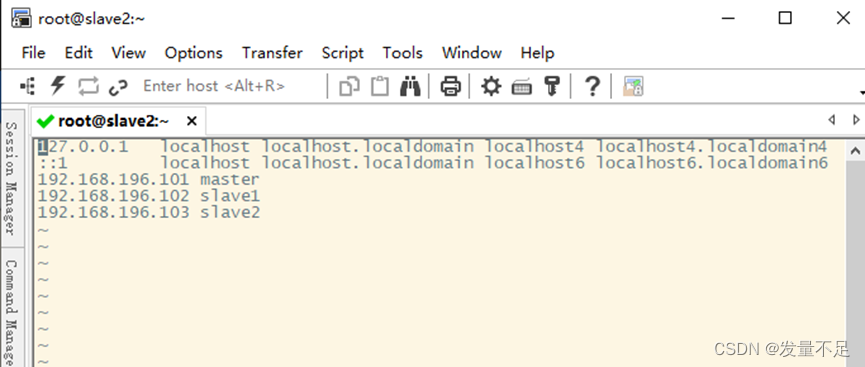

配置成刚才三个节点的ip地址

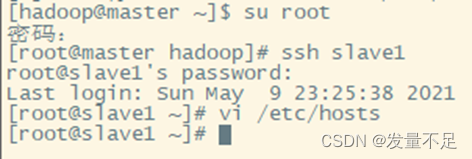

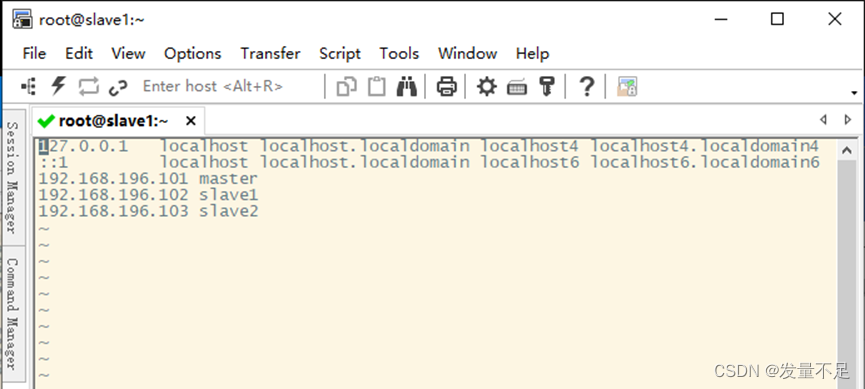

配置另外两个节点的免密快速访问(修改配置需要管理员root权限才能修改)

②.Spark集群安装部署

1.下载Spark安装包

Apache Spark官网httpd://spark.apache.org/downloads.html下载使用。

2.解压Spark安装包

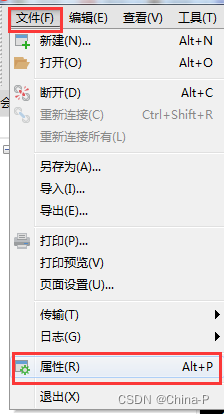

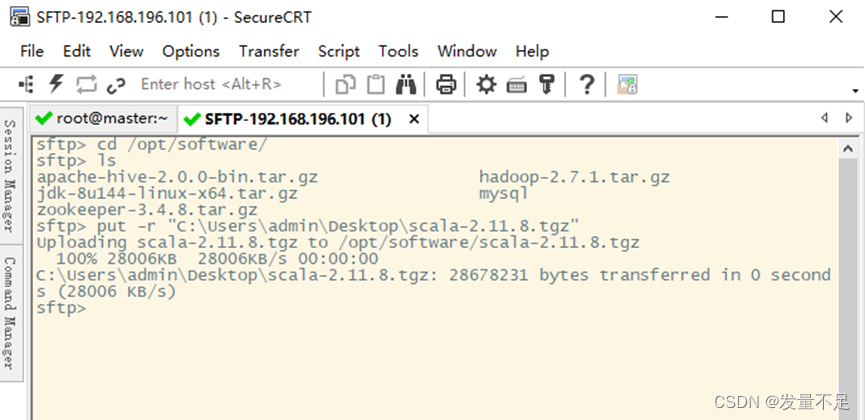

在CRT页面Alt+P打开文件传输窗口

cd /opt/software/

ls

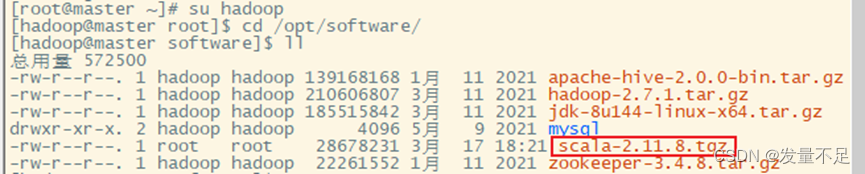

回到CRT页面切换hadoop用户

su Hadoop

cd /opt/software/

查看是否传输成功

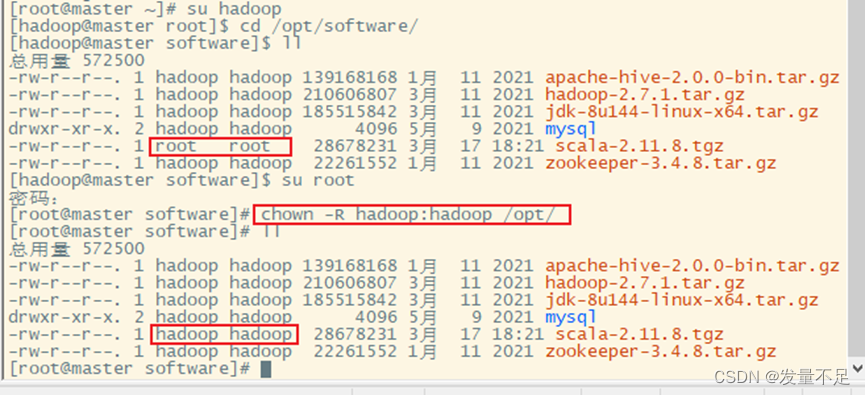

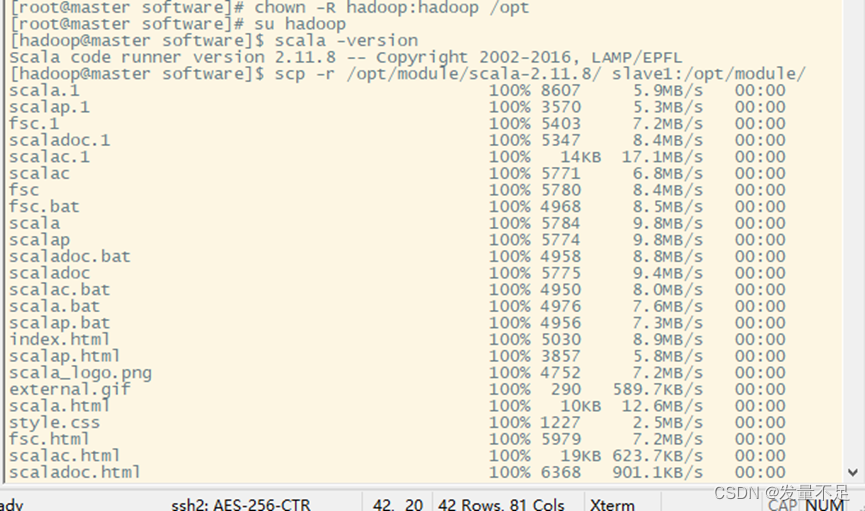

切换root修改scala的文件权限给hadoop

su Hadoop

cd /opt/software

su root

chown -R hadoop:hadoop /opt/

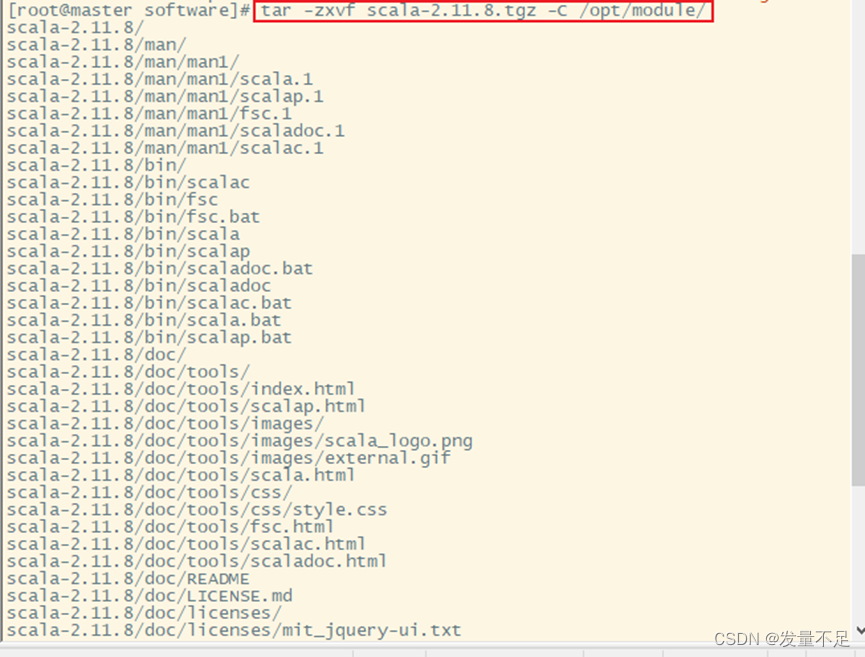

修改完成后解压scala

tar -zxvf scala-2.11.8.tgz -C /opt/module/

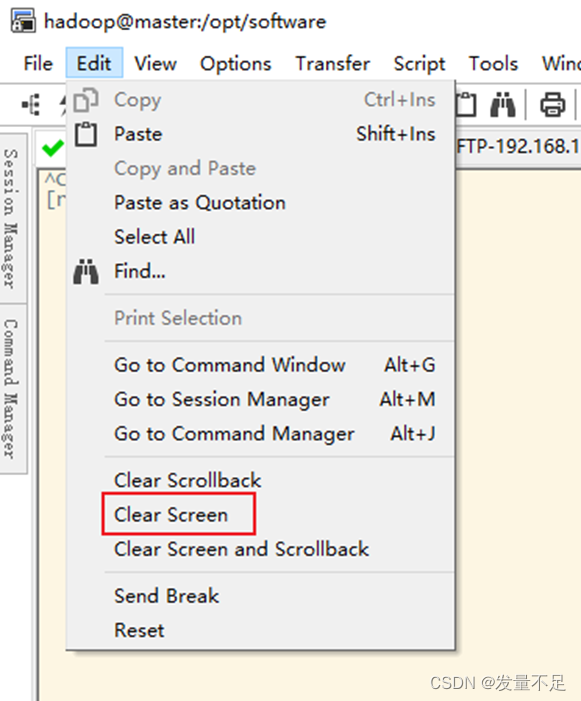

清屏

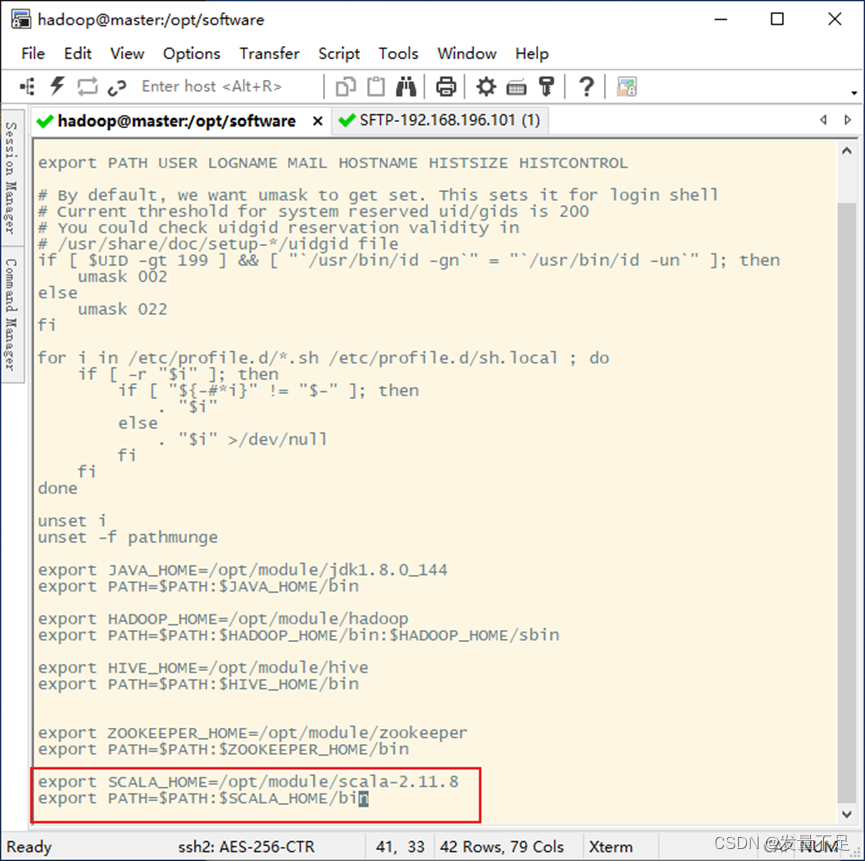

3.修改配置文件

vi /etc/profile

添加如下配置:

export SCALA_HOME=/opt/module/scala-2.11.8

export PATH=$PATH:$SCALA_HOME/bin

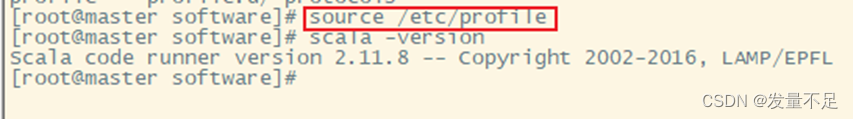

配置完后让配置生效

然后检查版本

分发文件:修改完1配置文件后将master目录分发至slave1和slave2两个节点

scp -r /opt/module/scala-2.11.8/ slave1:/opt/module/

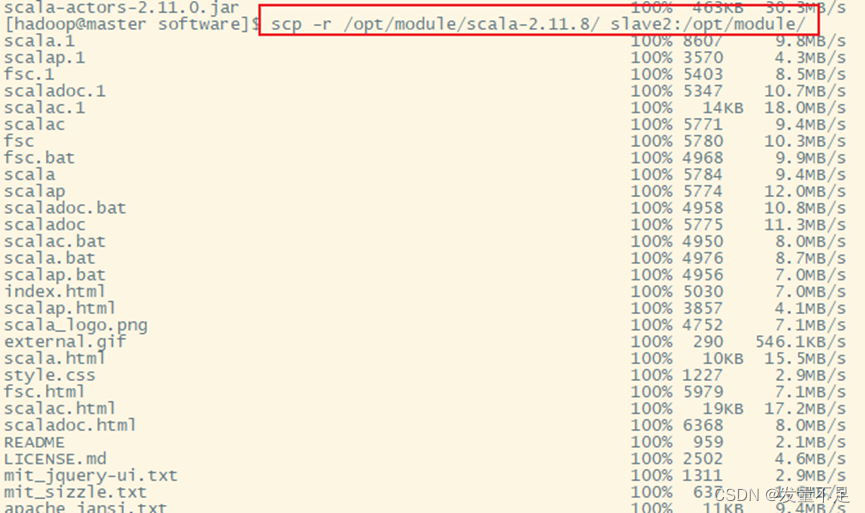

scp -r /opt/module/scala-2.11.8/ slave2:/opt/module/

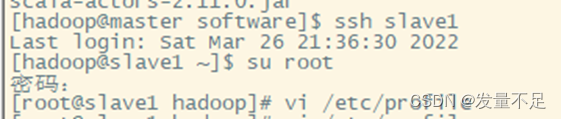

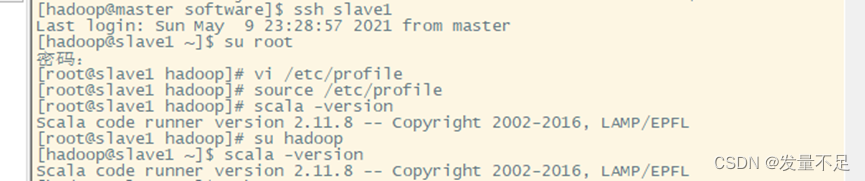

切换slave1用户使用管理员身份

ssh slave1

su root

vi /etc/profile

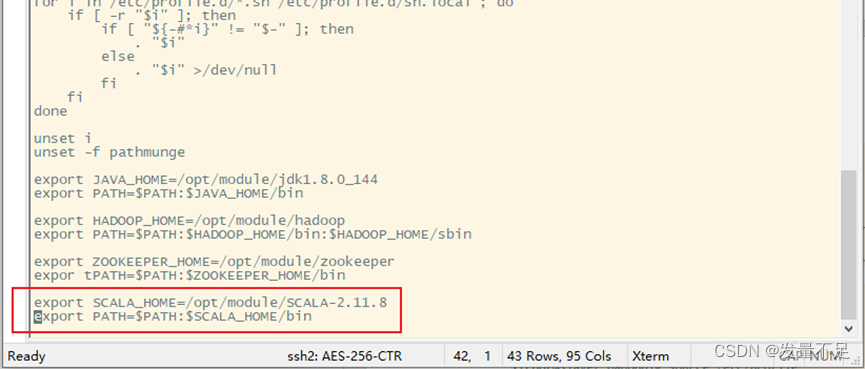

添加环境配置:

export SCALA_HOME=/opt/module/scala-2.11.8

export PATH=$PATH:$SCALA_HOME/bin

:wq保存

查看是否成功

scala -version

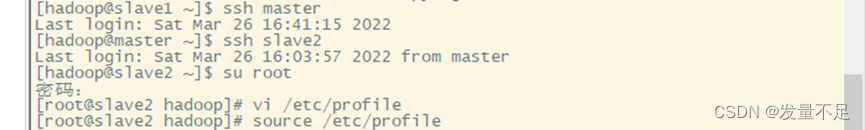

切换slave2用户使用管理员身份

ssh slave2

su root

vi /etc/profile

添加环境配置:

export SCALA_HOME=/opt/module/scala-2.11.8

export PATH=$PATH:$SCALA_HOME/bin

:wq保存

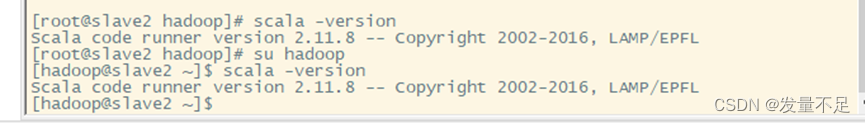

查看是否成功

scala -version

边栏推荐

猜你喜欢

随机推荐

HCIE学习记录——数据封装与常用协议(TCP/UDP)

炒鸡好用的音乐平台(插件)

记一次 ThreadLocal 泄漏导致的 shardingsphere-jdbc-core 单元测试偶发失败的排查与修复

华为单臂路由配置,实现不同vlan之间的通信

Oauth2.0 custom response values and exception handling

排序方法汇总(C语言)

tab 替换空格

华为Mux VLAN 二层流量隔离

OpenPose 基本理念

RTMP, RTSP, SRT 推流和拉流那些事

软件测试之WEB自动化

Oauth2.0 Supplement

小知识点系列-基于H2数据库单元测试

JMM&synchronized&volatile详解

makefile——杂项

转行软件测试,从零收入到月薪过万,人生迎来新转折

双链表(普通迭代器和常性迭代器)

Mobile copy constructor

Class template/assignment operations and add operations

webrtc 有关 SDP 部分的解析流程分析