当前位置:网站首页>CVPR 2020 - 频谱正则化

CVPR 2020 - 频谱正则化

2022-08-05 05:15:00 【sc0024】

Watch your Up-Convolution: CNN Based Generative Deep Neural Networks are Failing to Reproduce Spectral Distributions

论文:https://arxiv.org/abs/2003.01826

代码:https://github.com/cc-hpc-itwm/UpConv

摘要:生成式卷积深度神经网络,例如流行的GAN架构,依赖于基于卷积的上采样方法来生成非标量输出,例如图像或视频序列。在本文中,我们表明常见的上采样方法(即上卷积或转置卷积)导致此类模型无法正确再现自然训练数据的频谱分布。此效果与基础架构无关,我们证明了该效果可用于轻松地检测生成的数据,如Deepfake,其公开基准的准确度高达100%。为了克服当前生成模型的这一缺点,我们建议在训练优化目标中添加一个新的频谱正则项。我们证明了这种方法不仅允许训练避免高频误差的频谱一致性GAN。同样,我们表明,频谱的正确近似对生成网络的训练稳定性和输出质量具有积极影响。

1 Introduction

尽管GAN和VAE方法都已发布了许多不同的变体,例如具有不同的损失函数[18、4、20],不同的潜在空间约束[41、13、13、21、30]或生成器网络的各种深度神经网络(DNN)拓扑结构[47、43],所有这些方法必须遵循基本的数据生成原理:它们必须将样本从低维(通常为1D)和低分辨率的潜在空间转换为高分辨率(2D图像)的输出空间。因此,这些生成神经网络必须提供某种(可学习的)放大特性。

尽管所有这些生成方法都通过优化某些损失函数来指导其模型参数的学习,但最常用的损失仅集中于输出图像空间的属性,例如使用卷积神经网络(CNN)作为鉴别器网络来处理图像生成GAN中的隐式损耗。已经证明这种方法足以产生视觉上的声音输出,并且能够在某种程度上捕获图像空间中的数据(图像)分布。但是,众所周知,按比例放大操作会明显改变信号的频谱特性[28],从而在输出中引起高频失真。

Deepfake: 我们展示了我们的发现对Deepfake detection 任务的实际影响。 Deepfake [22,8]一词描述了最近人们滥用通过深层生成神经网络[7]伪造人脸的先进技术来产生名人和政客的虚假图像的现象。由于这种虚假图像可能对社会产生影响,因此,deepfake detection 已成为其自身的重要研究课题。文献[38、3、57]中报道的大多数方法本身都依赖CNN,因此需要大量带注释的训练数据。同样,[24]引入了具有对比损失函数的深层伪造鉴别器,[19]通过在CNN之上采用递归神经网络(RNN)合并了时域信息。

本文主要贡献:

- 我们通过实验证明了当前的生成神经网络体系结构无法正确估计训练数据的频谱分布。

我们利用这些频谱失真为生成的图像和视频提出了一个非常简单但高度准确的检测器,即DeepFake检测器,其在公共基准上的准确度达到了100%。

我们的理论分析和进一步的实验表明,常用的上采样单位(即上卷积)正在引起观察到的效果。

我们提出了一种新颖的频谱正则项,它能够补偿频谱失真。

我们还通过实验表明,在GAN训练中使用频谱正则化会导致更稳定的模型并提高视觉输出质量。

2 上卷积对频谱的影响

2.1 使用DFT功率谱上的方位积分分析图像的光谱分布

对M×N的2D图像进行DFT分解:

2.2 生成式DNN的上卷积

像GAN这样的生成型神经体系结构会产生高维输出,例如来自非常低维的潜在空间的图像。因此,所有这些方法都需要在通过网络传播数据时使用某种扩展机制。图3中说明了文献中流行的框架(如TensorFlow [2]和PyTorch [44])中最常用的两种缩放技术,如图3所示:通过插值(up + conv)和转置卷积(transconv)进行上卷积。我们使用非常简单的自动编码器(AE)设置(请参见图4)来初步研究上采样后上卷积单元对2d图像的频谱特性的影响。图5显示了两种方法对频谱的不同但巨大的影响。图6给出了重建图像的定性结果,表明频谱中的错误与视觉外观有关。

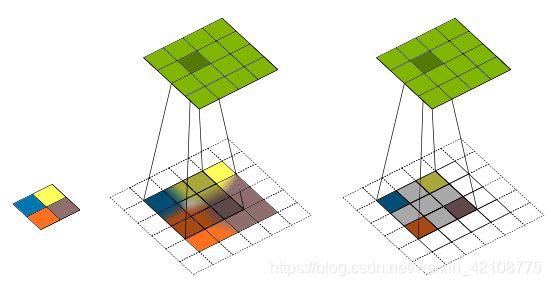

图3:两个最常见的上卷积单元的示意图。左图:低分辨率输入图像(此处为2×2);中间图:通过插值进行向上卷积(up + conv)-通过插值(双线性或最近邻)对输入进行缩放,然后与标准可学习的卷积核(大小为3×3)进行卷积以形成5x5输出(绿色),右图:转置卷积(transconv)用“bed of nails”方案(灰色网格点为零)填充输入,然后与标准卷积核进行卷积,以形成5×5输出(绿色)。

2.3 理论分析

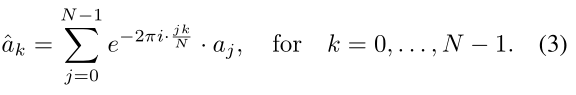

不失一般性,考虑一个一维信号a 和它的DFT  :

:

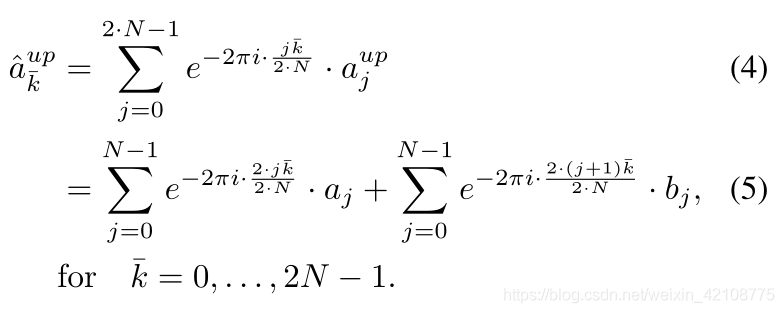

如果将a的空间分辨率提高2倍:

两种情况:

(1)bed of nails 插值(转置卷积)时:

(2)双线性插值(up + conv)时:

先讨论第(1)种:

此时公式(5)的第二项为0,第一项近似等于FT,k换成  。因此,将空间分辨率提高2倍将导致频率轴以1/2缩放。现在让我们从采样理论的角度考虑效果:

。因此,将空间分辨率提高2倍将导致频率轴以1/2缩放。现在让我们从采样理论的角度考虑效果:

因为与狄拉克脉冲梳的逐点乘法仅去除了 的值。假设周期信号并应用卷积定理[31],根据公式(6)我们得到

的值。假设周期信号并应用卷积定理[31],根据公式(6)我们得到

因此,“bed of nails 上采样”将在  中创建信号的高频副本。要删除这些频率副本,需要对上采样的信号进行适当的平滑处理。超过N/2的所有观测空间频率都是潜在的上采样伪像。从理论上看是显而易见的,但我们在图8中也实践证明,使用常用的3×3卷积滤波器无法校正这么大的频带(假设中到高分辨率的图像)。

中创建信号的高频副本。要删除这些频率副本,需要对上采样的信号进行适当的平滑处理。超过N/2的所有观测空间频率都是潜在的上采样伪像。从理论上看是显而易见的,但我们在图8中也实践证明,使用常用的3×3卷积滤波器无法校正这么大的频带(假设中到高分辨率的图像)。

第(2)种:

双线性插值的情况下,我们在等式(5)中有  ,其对应于与

,其对应于与  相邻的值的平均滤波。由于对偶性和卷积定理,这等效于频谱

相邻的值的平均滤波。由于对偶性和卷积定理,这等效于频谱  与sinc函数的逐点乘法,从而抑制了虚假的高频信息。然而,预期所得频谱在高频域中会过低。

与sinc函数的逐点乘法,从而抑制了虚假的高频信息。然而,预期所得频谱在高频域中会过低。

3 学习正确的频谱分布

3.1 频谱正则化

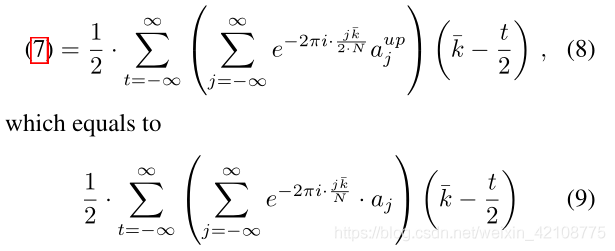

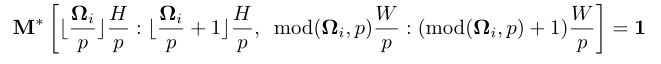

由于我们已经在使用方位角积分AI(参见等式(2))测量频谱失真,并且AI是可微的,因此  的一个简单选择是生成的输出

的一个简单选择是生成的输出 与从真实样本获得的平均

与从真实样本获得的平均  之间的二进制交叉熵:

之间的二进制交叉熵:

M是图像大小,为了将方位角积分的值缩放为[0,1],我们使用第0个系数( )进行归一化。

)进行归一化。

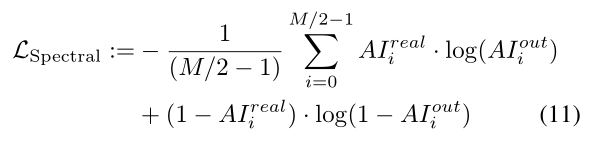

对于不同的λ值,将2.2节的频谱损失加到AE设置中的效果如图7所示。正如在2.3节中分析预测的那样,即使对于较大的λ值,也无法通过单个学习到的3×3滤波器来校正观察到的效果。因此,我们需要重新考虑架构参数。

3.2 上卷积的卷积核大小

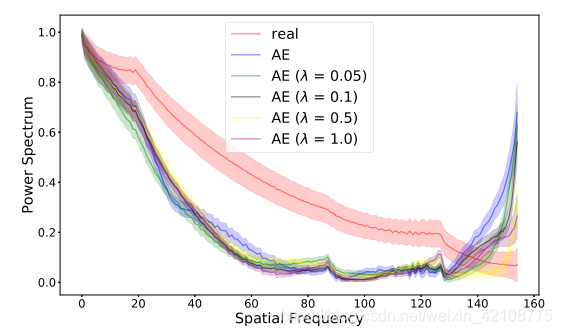

在图8中,我们根据卷积核大小和卷积层数评估了2.2节中AE的频谱损失。我们考虑将解码器滤波器大小从3×3更改为11×11以及1或3个卷积层。虽然无法通过单个甚至三个3×3卷积来消除来自上采样的频谱失真,但是当学习更多更大的滤波器时,可以通过我们提出的损失函数进行校正。

4 实验评估

4.1 Deepfake Detection

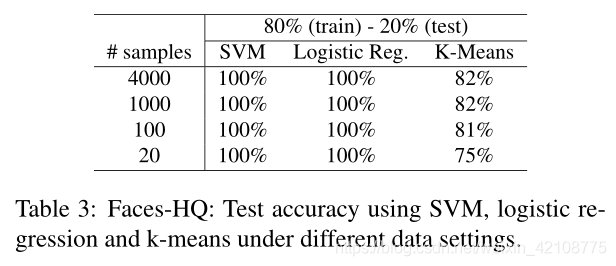

在本节中,我们表明,由最新的GAN上卷积引起的频谱失真可用于轻松识别“伪造”图像数据。仅使用少量带注释的训练数据,甚至是无监督的设置,我们就能以几乎完美的准确性检测来自公共基准的生成的面孔。

三个面部数据集:FaceForensics++(80 × 80 × 3)、The CelebFaces Attributes (CelebA)(178×218×3)、Faces-HQ(1024*1024)

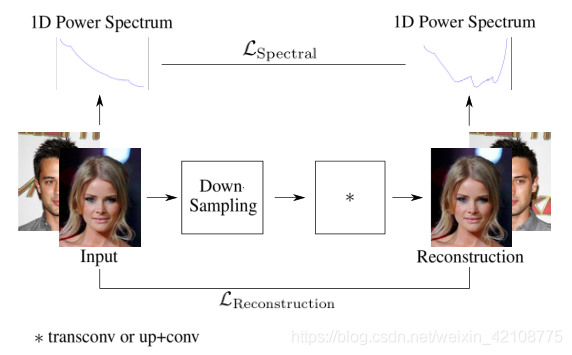

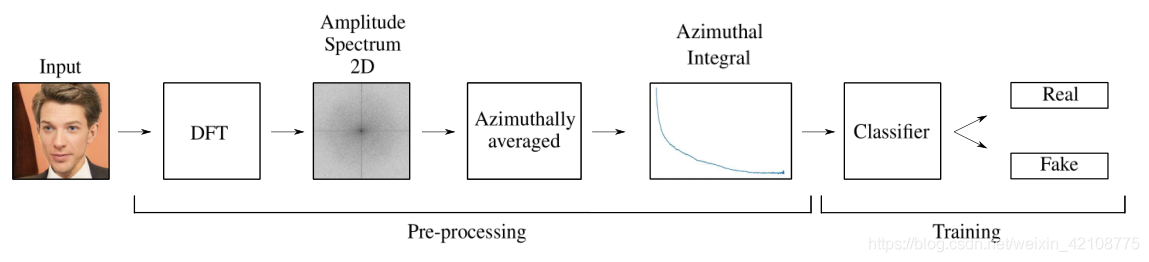

图9展示了我们的处理流程,通过方位角积分从样本中提取光谱特征(参见图2),然后使用基本SVM [51]分类器进行监督,使用K-Means [36]进行无监督伪造检测。对于每个实验,我们随机选择不同大小的训练集,并使用其余数据进行测试。为了处理不同尺寸的输入图像,我们根据第0个系数归一化1D功率谱,并将得到的1D特征向量缩放为固定大小。

图15显示,真脸和“假”脸在我们的频谱特征空间的高频范围内形成了轮廓分明的簇。表3中的实验结果证实,由上采样单元引起的功率谱失真是一个常见问题,可以轻松检测生成的内容。这个简单的指标甚至优于使用大型带注释的训练集的基于DNN的复杂检测方法。

4.2 应用频谱正则化

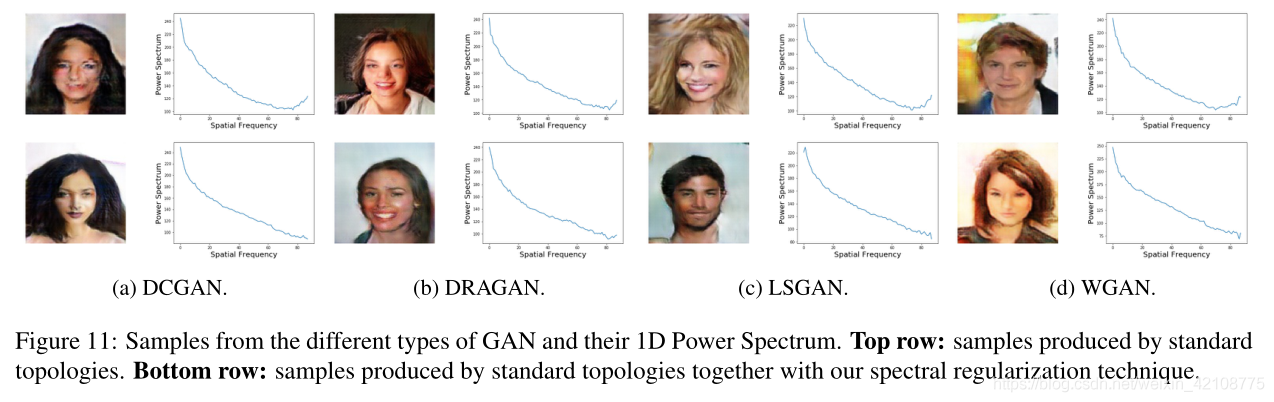

在现有的GAN架构的基础上做了两处改进:首先,我们在发生器损失函数上增加一个频谱损失项(见等式(11))。我们使用来自数据集的1000个未注释的真实样本来估计 ,这是计算频谱损失所必需的。其次,我们将最后一个上卷积单元之后的卷积层更改为核大小为5×5的三个滤波器层。图1的底部图显示了与原始GAN架构直接比较后该实验的结果。图11中给出了在没有和没有我们建议的正则化条件下产生的一些定性结果。

,这是计算频谱损失所必需的。其次,我们将最后一个上卷积单元之后的卷积层更改为核大小为5×5的三个滤波器层。图1的底部图显示了与原始GAN架构直接比较后该实验的结果。图11中给出了在没有和没有我们建议的正则化条件下产生的一些定性结果。

4.3 频谱正则化项的好处

通过规范化频谱,我们获得了产生合成图像的直接好处,这些图像不仅看起来逼真,而且可以模拟频域中的行为。这样,我们就可以更接近真实分布中的样本图像了。此外,此正则化还有一个有趣的副作用。在我们的实验过程中,我们注意到具有频谱损耗项的GAN在避免“模式崩溃” [18]和更好的收敛性方面似乎更加稳定。众所周知,GAN可能会面临挑战性和不稳定的训练过程,几乎没有理论可以解释这种现象。这使得尝试使用新的生成器变体或将它们应用于新领域变得极为困难,这极大地限制了它们的适用性。

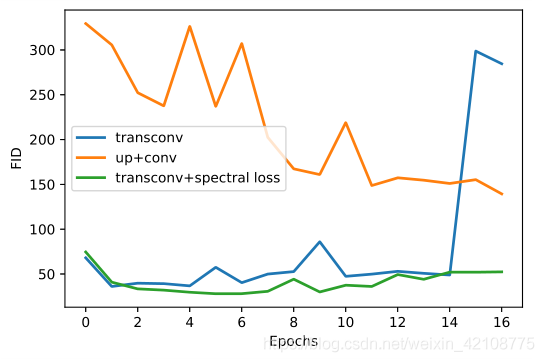

为了研究频谱正则化对GAN训练的影响,我们进行了一系列实验。通过采用一组不同的基线架构,我们评估了光谱正则化的稳定性,并在CelebA数据集上提供了定量结果。我们的评估指标是Fréchet起始距离(FID)[23],它使用在ImageNet [12]上进行预训练的Inception-v3 [52]网络从中间层提取特征。

图13和图14显示了使用带有不同上卷积单位和具有频谱损失的相应版本的baselineGAN实施方式,FID随着epoch的变化。这些结果在FID度量方面显示出明显的积极作用,其中频谱正则化使整个训练过程稳定且低FID,而未规整的GAN往往会“崩溃”。图12可视化了高FID值与失败的GAN图像生成之间的相关性。

5 结论

我们证明了常见的“最新技术”卷积生成网络,例如流行的GAN图像生成器,无法近似真实数据的频谱分布。这一发现具有重大的实际意义:不仅可以用来轻松地识别生成的样本,还意味着所有用于训练数据生成或迁移学习的方法从根本上都是有缺陷的,并且不能指望当前的方法能够正确地近似真实的数据分布。但是,我们表明有解决此问题的简单方法:通过将我们提出的频谱正则化添加到生成器损失函数中,并将最终生成器卷积的滤波器大小增加到至少5×5,就能够补偿频谱误差。在实验上,我们发现有力的迹象表明,频谱正则化对GAN的训练稳定性具有非常积极的影响。尽管这种现象需要进一步的理论研究,但从直觉上讲这是有道理的,因为众所周知,高频噪声会对基于CNN的鉴别器网络产生强烈影响,这可能会导致生成器的过拟合。

实验细节见附录~

边栏推荐

- MSRA提出学习实例和分布式视觉表示的极端掩蔽模型ExtreMA

- 【数据库和SQL学习笔记】8.SQL中的视图(view)

- day9-字符串作业

- Flink EventTime和Watermarks案例分析

- [Let's pass 14] A day in the study room

- 如何编写一个优雅的Shell脚本(三)

- 【After a while 6】Machine vision video 【After a while 2 was squeezed out】

- [Go through 10] sklearn usage record

- BroadCast Receiver(广播)详解

- 数据库期末考试,选择、判断、填空题汇总

猜你喜欢

Flink Broadcast 广播变量

Detailed explanation of BroadCast Receiver (broadcast)

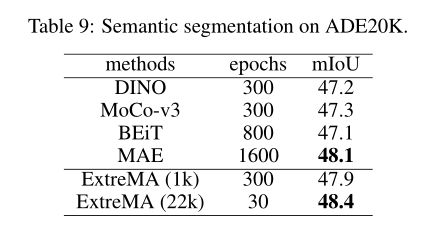

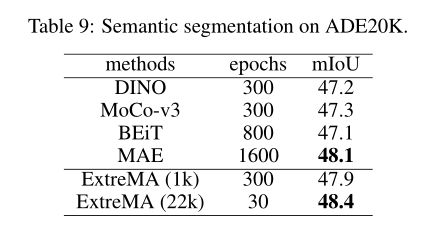

MSRA proposes extreme masking model ExtreMA for learning instances and distributed visual representations

BFC详解(Block Formmating Context)

MSRA提出学习实例和分布式视觉表示的极端掩蔽模型ExtreMA

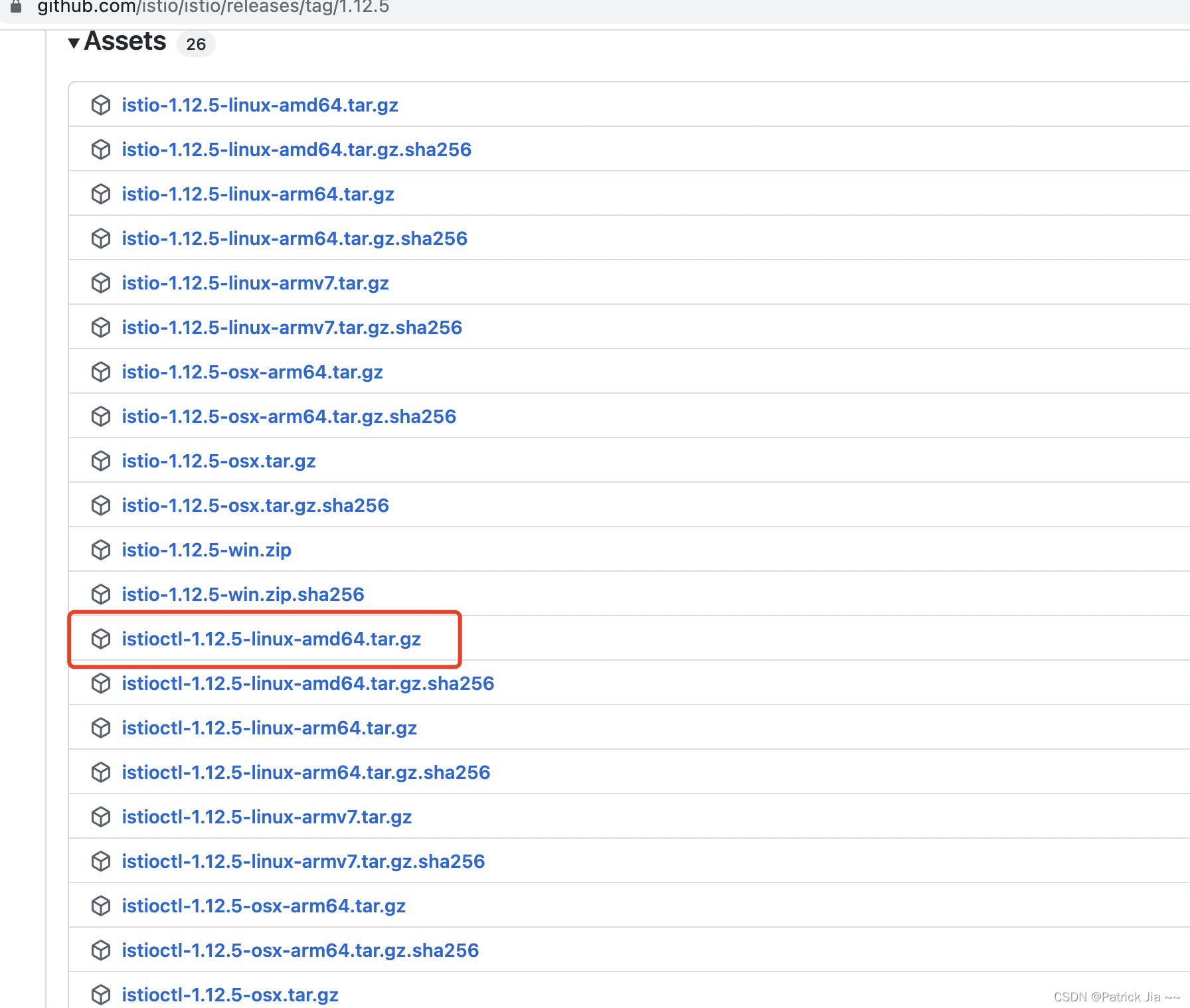

服务网格istio 1.12.x安装

如何停止flink job

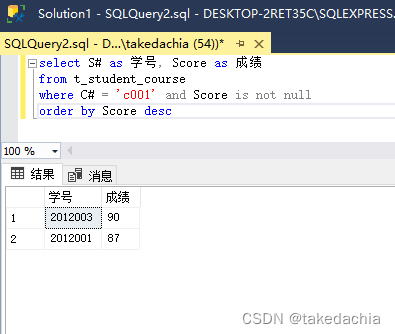

【数据库和SQL学习笔记】4.SELECT查询2:排序(ORDER BY)、聚合函数、分组查询(GROUP BY)

![[Go through 8] Fully Connected Neural Network Video Notes](/img/0a/8b2510b5536621f402982feb0a01ef.png)

[Go through 8] Fully Connected Neural Network Video Notes

It turns out that the MAE proposed by He Yuming is still a kind of data enhancement

随机推荐

You should write like this

redis persistence

day6-列表作业

【零基础开发NFT智能合约】如何使用工具自动生成NFT智能合约带白名单可Mint无需写代码

flink项目开发-flink的scala shell命令行交互模式开发

【Reading】Long-term update

day9-字符串作业

【Pytorch学习笔记】11.取Dataset的子集、给Dataset打乱顺序的方法(使用Subset、random_split)

Flink EventTime和Watermarks案例分析

CVPR best paper winner Huang Gao's team from Tsinghua University presented the first dynamic network review

flink项目开发-配置jar依赖,连接器,类库

【NFT开发】设计师无技术基础保姆级开发NFT教程在Opensea上全套开发一个NFT项目+构建Web3网站

Tensorflow踩坑笔记,记录各种报错和解决方法

SQL(1) - Add, delete, modify and search

【论文阅读-表情捕捉】ExpNet: Landmark-Free, Deep, 3D Facial Expressions

SharedPreferences and SQlite database

CVPR最佳论文得主清华黄高团队提出首篇动态网络综述

【数据库和SQL学习笔记】8.SQL中的视图(view)

如何停止flink job

[Go through 4] 09-10_Classic network analysis