当前位置:网站首页>BatchNorm&&LayerNorm

BatchNorm&&LayerNorm

2022-08-04 05:29:00 【CV小Rookie】

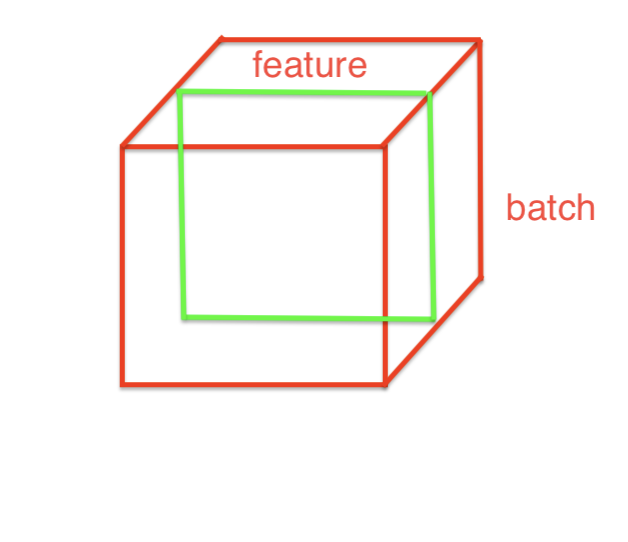

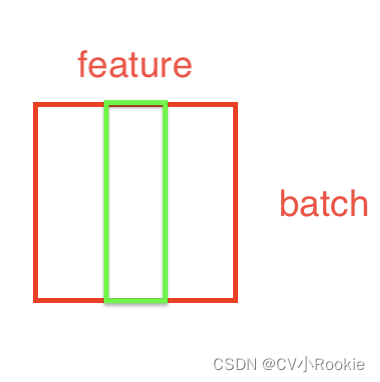

以二维输入情况为例:

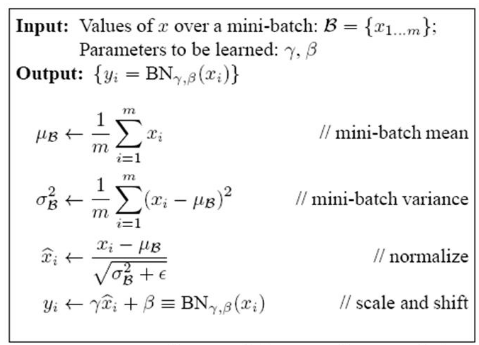

BatchNorm:

对一列,也就是某一个特征进行操作:均值变为0,方差变为1;

变换后某个神经元的激活x形成了均值为0,方差为1的正态分布,目的是把值往后续要进行的非线性变换的线性区拉动,增大导数值,增强反向传播信息流动性,加快训练收敛速度。

但是这样会导致网络表达能力下降,为了防止这一点,每个神经元增加两个调节参数(scale和shift),这两个参数是通过训练来学习到的,用来对变换后的激活反变换,使得网络表达能力增强,即对变换后的激活进行如下的scale和shift操作。

LayerNorm:

对每一个样本(也就是一行)进行与BatchNorm一样的操作。

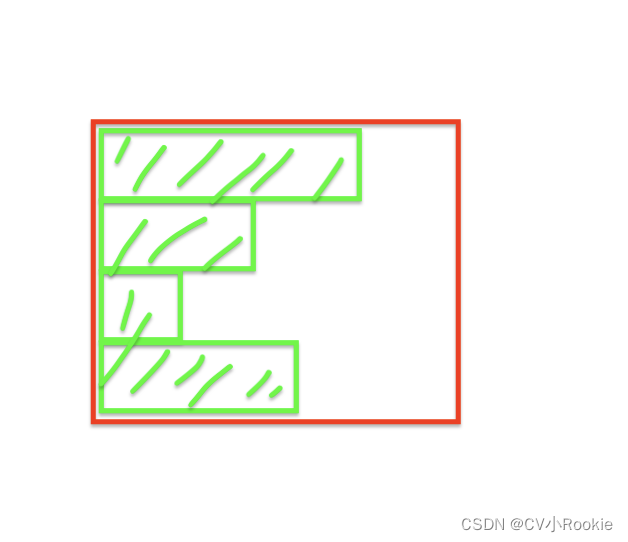

以三维输入情况为例:

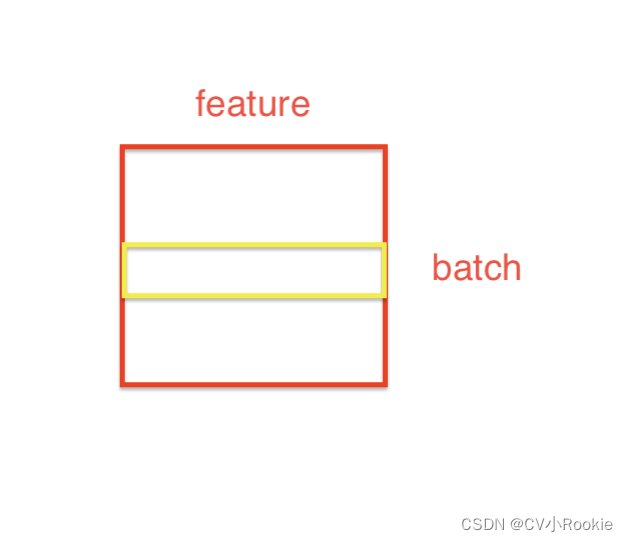

BatchNorm:

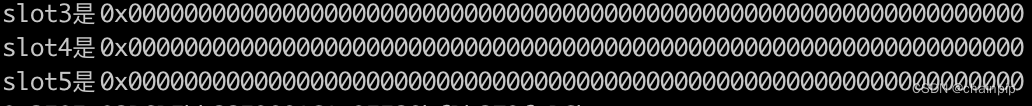

右图为截面图,可以看到由于样本长度不定,所以在计算mini_batch的均值与方差的时候抖动特别大。预测时是需要记住全局的均值与方差,当预测时碰倒未见过的样本,训练出来的方差与均值不好用 。

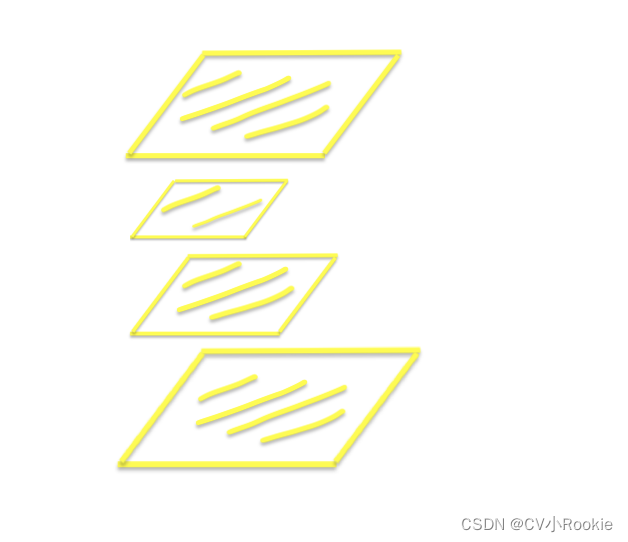

LayerNorm:

LayerNorm计算的是样本的方差与均值,不需要计算全局的。相对来说比较稳定。

边栏推荐

- 【CV-Learning】Image Classification

- [Deep Learning 21 Days Learning Challenge] 2. Complex sample classification and recognition - convolutional neural network (CNN) clothing image classification

- flink on yarn指定第三方jar包

- postgresql 事务隔离级别与锁

- TensorFlow2 study notes: 6. Overfitting and underfitting, and their mitigation solutions

- (十三)二叉排序树

- (TensorFlow) - detailed explanation of tf.variable_scope and tf.name_scope

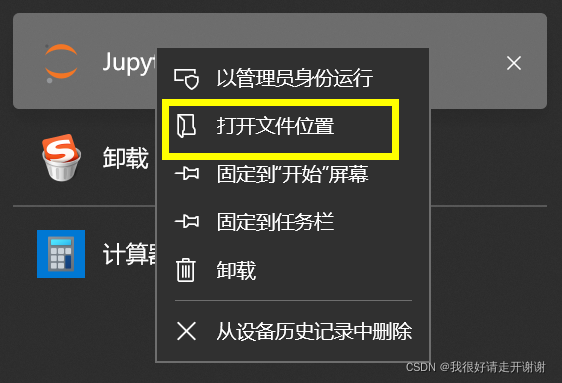

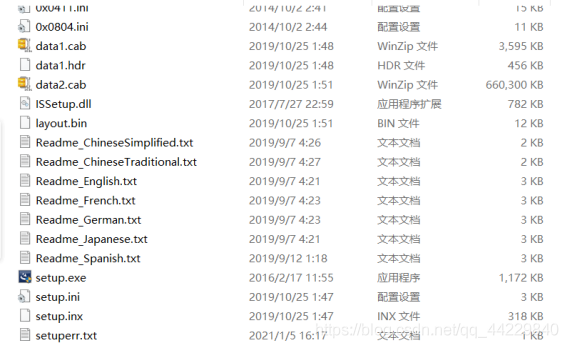

- 【深度学习21天学习挑战赛】0、搭建学习环境

- read and study

- 【CV-Learning】Object Detection & Instance Segmentation

猜你喜欢

随机推荐

8.30难题留坑:计数器问题和素数等差数列问题

组原模拟题

Logistic Regression --- Introduction, API Introduction, Case: Cancer Classification Prediction, Classification Evaluation, and ROC Curve and AUC Metrics

CAS与自旋锁、ABA问题

数据库根据提纲复习

Vision Transformer 论文 + 详解( ViT )

yolov3数据读入(二)

【CV-Learning】线性分类器(SVM基础)

视图、存储过程、触发器

【树 图 科 技 头 条】2022年6月27日 星期一 今年ETH2.0无望

flink sql left join数据倾斜问题解决

(十)树的基础部分(一)

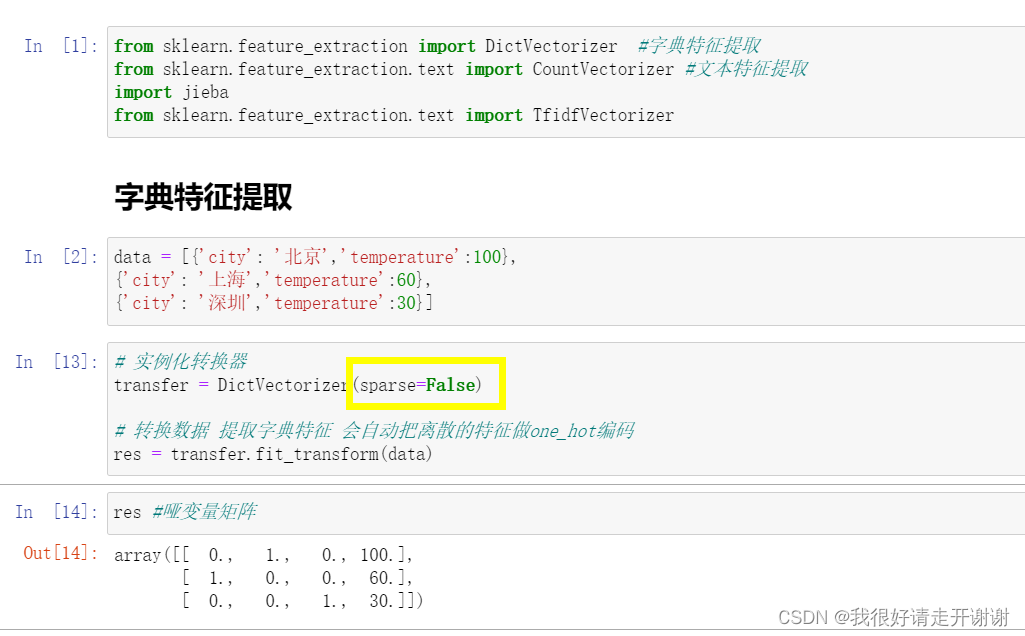

The pipeline mechanism in sklearn

MySQL事务详解(事务隔离级别、实现、MVCC、幻读问题)

Kubernetes基本入门-名称空间资源(三)

[Introduction to go language] 12. Pointer

SQL练习 2022/7/3

Android connects to mysql database using okhttp

flink-sql所有表格式format

postgresql 事务隔离级别与锁