当前位置:网站首页>[论文阅读] Semi-supervised Left Atrium Segmentation with Mutual Consistency Training

[论文阅读] Semi-supervised Left Atrium Segmentation with Mutual Consistency Training

2022-07-06 23:36:00 【xiongxyowo】

[论文地址] [代码] [MICCAI 21]

Abstract

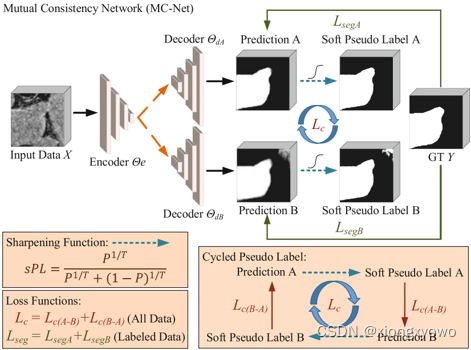

半监督学习在机器学习领域引起了极大的关注,特别是对于医学图像分割任务,因为它减轻了收集大量密集注释数据进行训练的沉重负担。然而,现有的大多数方法在训练过程中低估了具有挑战性的区域(如小分支或模糊的边缘)的重要性。我们认为,这些未标记的区域可能包含更多的关键信息,以最大限度地减少模型的不确定性预测,并应在训练过程中予以强调。因此,在本文中,我们提出了一种新型的相互一致网络(MC-Net),用于从三维MR图像中进行半监督的左心房分割。特别是,我们的MC-Net由一个编码器和两个略有不同的解码器组成,两个解码器的预测差异被我们设计的循环伪标签方案转化为无监督的损失,以鼓励相互一致。这种相互一致性鼓励两个解码器有一致的、低熵的预测,并使模型能够逐渐从这些未标记的挑战性区域中捕捉泛化的特征。我们在公共的左心房(LA)数据库上评估了我们的MC-Net,它通过有效利用未标记的数据获得了令人印象深刻的性能提升。我们的MC-Net在左心房分割方面优于最近的六种半监督方法,并在LA数据库中创造了新的最先进的性能。

Method

本文的总体思路是设计一种更好的伪标签以提升半监督性能,流程如下:

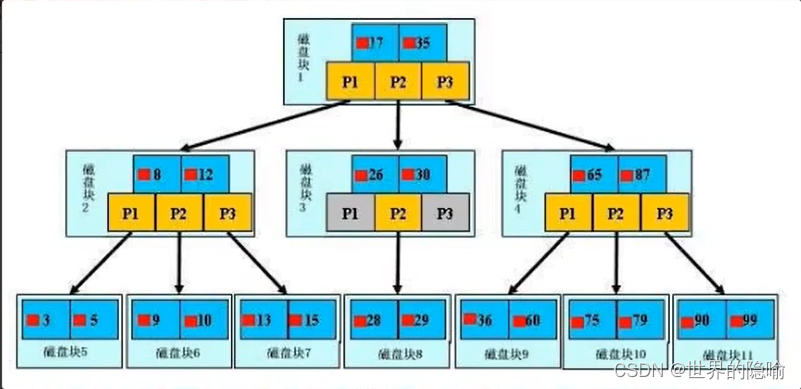

首先是如何衡量不确定性(uncertainty)的问题。本文的认为流行的方法诸如MC-Dropout需要在训练时进行多次推理,会带来额外的时间开销,因此这里做了一个"空间换时间"的方式,即设计了一个辅助解码器 D B D_B DB,这个解码器在结构上是"十分简单的",直接是多次上采样插值以获得最终的结果。而原始的解码器 D A D_A DA则与 V − N e t V-Net V−Net保持一致。

这样一套下来,在不引入较大网络参数情况的情况下(因为辅助解码器的结构太简单了),模型便可以在一次推理的情况下获得两个不同的结果,而显然辅助解码器的结果会是"比较差的"(这个从图中也能看出来)。最终算不确定性的时候只需要比较这两个结果的差异即可。

这一做法虽然看起来很简单,但仔细想想还挺神奇的;一强一弱两个分类头,如果样本比较简单,那么弱的分类头也能得到一个比较好的结果,此时两个结果的差异较小,不确定程度较低。而对于一些信息量较大的样本,弱分类头结果较差,此时两个结果的差异较大,不确定性更高。

而对于得到的两个结果,首先用一个锐化函数对其处理,来消除掉预测结果中一些潜在的噪声。锐化函数定义如下: s P L = P 1 / T P 1 / T + ( 1 − P ) 1 / T s P L=\frac{P^{1 / T}}{P^{1 / T}+(1-P)^{1 / T}} sPL=P1/T+(1−P)1/TP1/T 而在使用伪标签监督的时候,则使用B的预测结果来监督A,使用A的结果来监督B。这样就可以使得强解码器 D A D_A DA能学到弱编码器中的不变特征来减轻过拟合,而弱编码器 D B D_B DB也可以学到强编码器 D A D_A DA中的高级特征。

边栏推荐

猜你喜欢

JVM (19) -- bytecode and class loading (4) -- talk about class loader again

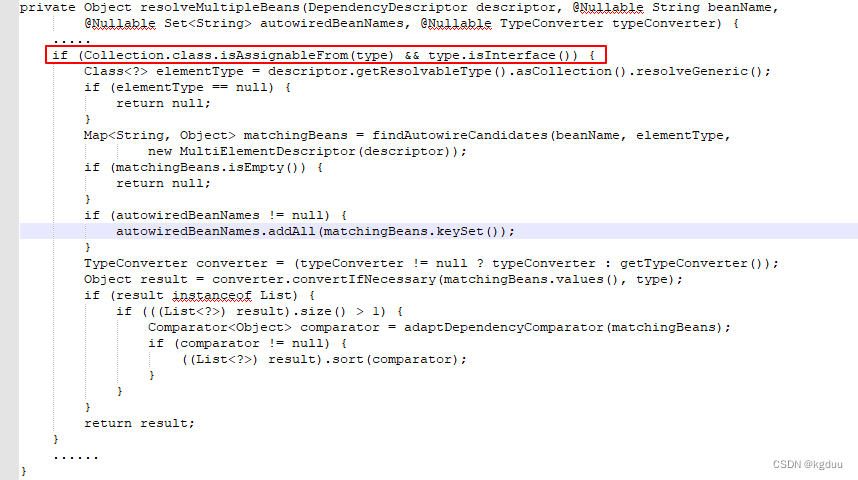

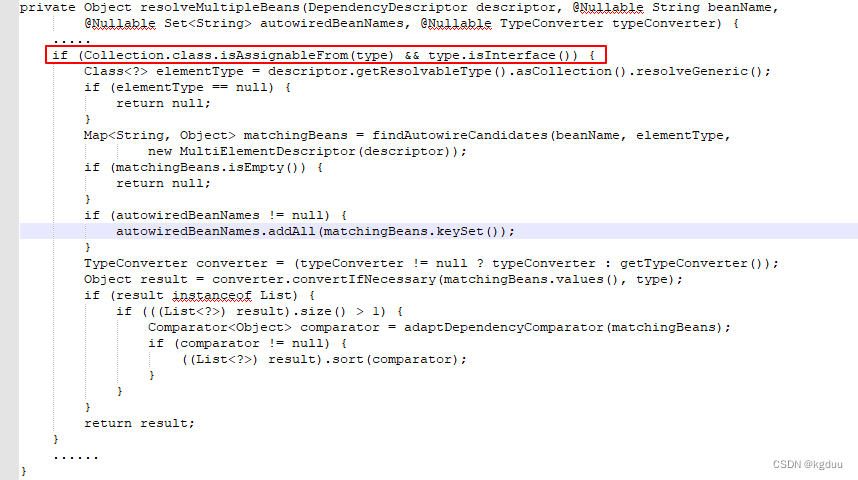

Phenomenon analysis when Autowired annotation is used for list

【js组件】date日期显示。

PMP证书有没有必要续期?

Under the trend of Micah, orebo and apple homekit, how does zhiting stand out?

Autowired注解用于List时的现象解析

什么是依赖注入(DI)

MySQL数据库学习(8) -- mysql 内容补充

《5》 Table

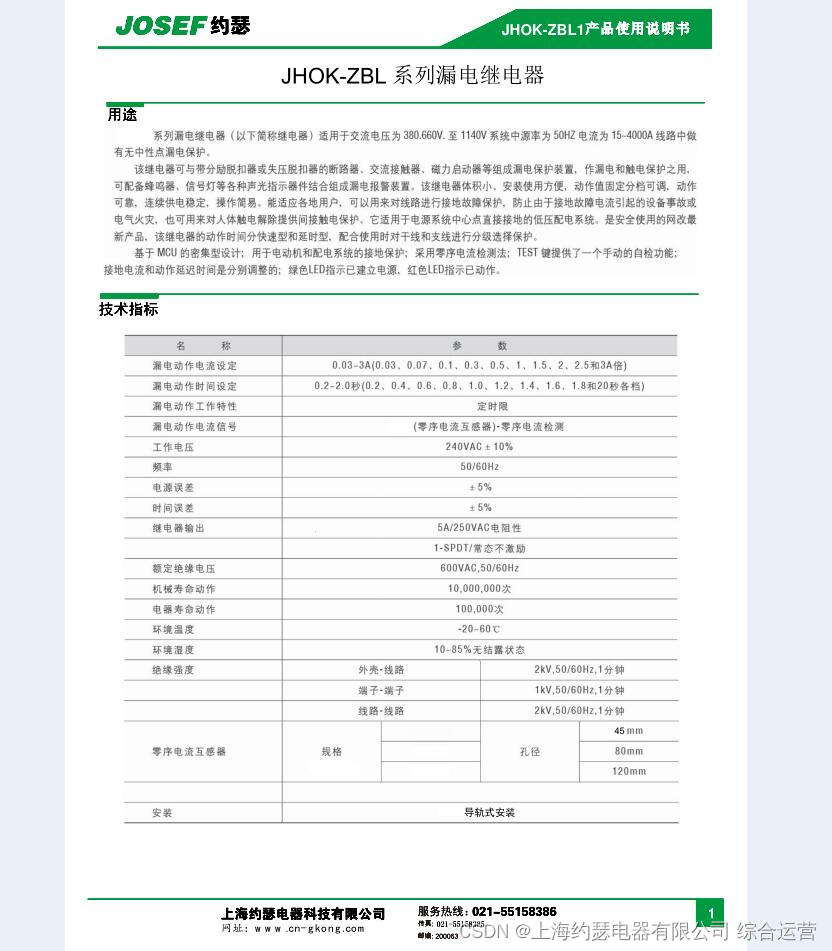

JHOK-ZBL1漏电继电器

随机推荐

As we media, what websites are there to download video clips for free?

[optimal web page width and its implementation] [recommended collection "

JHOK-ZBL1漏电继电器

Use, configuration and points for attention of network layer protocol (taking QoS as an example) when using OPNET for network simulation

np. random. Shuffle and np Use swapaxis or transfer with caution

How Alibaba cloud's DPCA architecture works | popular science diagram

Talk about mvcc multi version concurrency controller?

照片选择器CollectionView

痛心啊 收到教训了

ThinkPHP Association preload with

pytest测试框架——数据驱动

Senior programmers must know and master. This article explains in detail the principle of MySQL master-slave synchronization, and recommends collecting

How does redis implement multiple zones?

QSlider of QT control style series (I)

[JS component] date display.

Make web content editable

论文阅读【Sensor-Augmented Egocentric-Video Captioning with Dynamic Modal Attention】

Summary of the mean value theorem of higher numbers

DJ-ZBS2漏电继电器

QT控件样式系列(一)之QSlider