当前位置:网站首页>深度学习理论 —— 初始化、参数调节

深度学习理论 —— 初始化、参数调节

2022-08-04 05:30:00 【学习历险记】

初始化

深度学习模型训练的过程本质是对参数w进行更新,这需要每个参数有相应的初始值。

为什么要初始化?

神经网络要优化一个非常复杂的非线性模型,而且基本没有全局最优解,初始化在其中扮演着非常重要的作用。

□ 初始点的选取,有时能够决定算法是否收敛;

□ 当收敛时,初始点可以决定学习收敛的多快,是否收敛到一个代价高或低的点;

□ 过大的初始化导致梯度爆炸,过小的初始化导致梯度消失。

什么是好的初始化?

好的初始化应该满足以下两个条件:

□ 让神经元各层激活值不会出现饱和现象;

□ 各层激活值也不能为0。

全零初始化:参数初始化为0。

缺点:同一层的神经元会学习到相同的特征,不能破坏不同神经元的对称性质。

如果神经元的权重被初始化为0,所有神经元的输出都将是相同的,除了输出之外,所有的中间层的节点的值都为零。一般神经网络拥有对称的结构,那么在进行第一次误差反向传播时,更新后的网络参数将会相同,在下一次更新时,相同的网络参数学习提取不到有用的特征,因此深度学习模型都不会使用0初始化所有参数。

参数调节

批量 batchsize 选择2的指数倍 与计算机内存相符

超参数调节方法

试错法、网络搜索、随机搜索、贝叶斯优化、高斯过程

边栏推荐

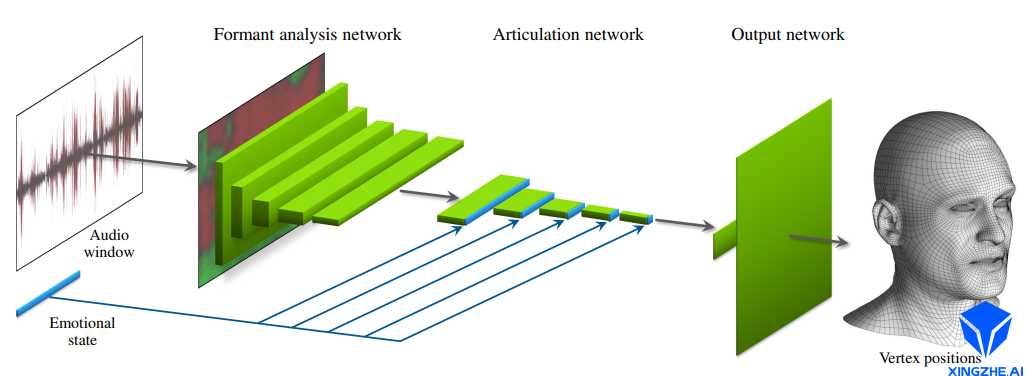

- 语音驱动嘴型与面部动画生成的现状和趋势

- Pytest常用插件

- fill_between in Matplotlib; np.argsort() function

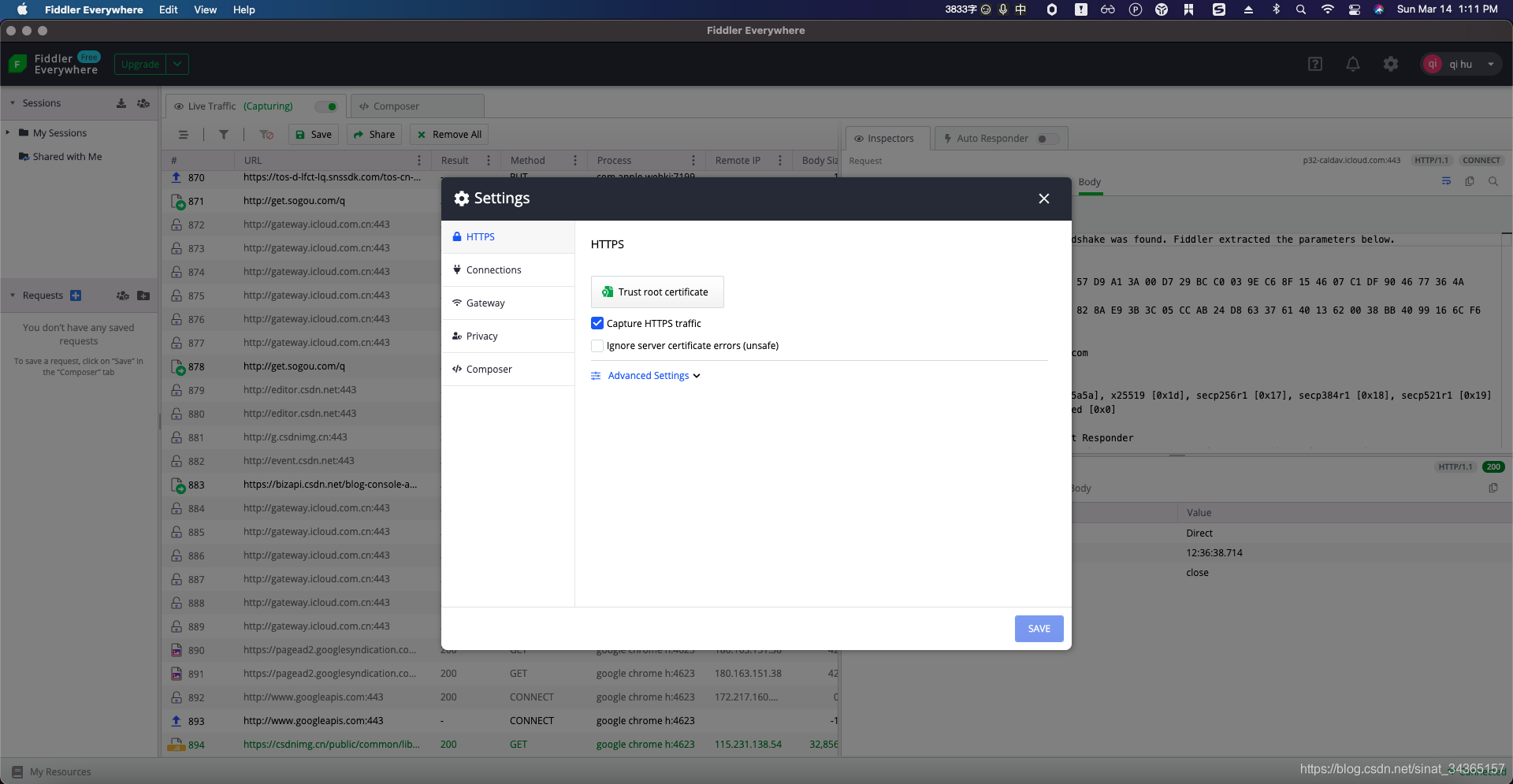

- 浅谈外挂常识和如何防御

- 如何用Pygame制作简单的贪吃蛇游戏

- [Deep Learning 21 Days Learning Challenge] 2. Complex sample classification and recognition - convolutional neural network (CNN) clothing image classification

- 【代码学习】

- 图像形变(插值方法)

- Pytorch问题总结

- [Deep Learning 21 Days Learning Challenge] Memo: What does our neural network model look like? - detailed explanation of model.summary()

猜你喜欢

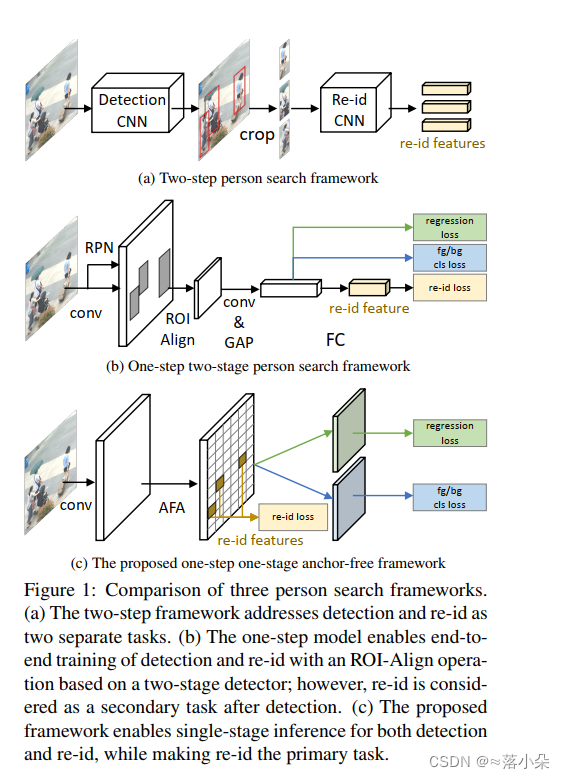

【论文阅读】Anchor-Free Person Search

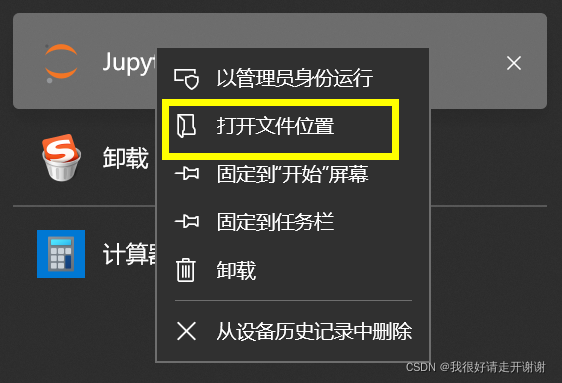

Jupyter Notebook安装库;ModuleNotFoundError: No module named ‘plotly‘解决方案。

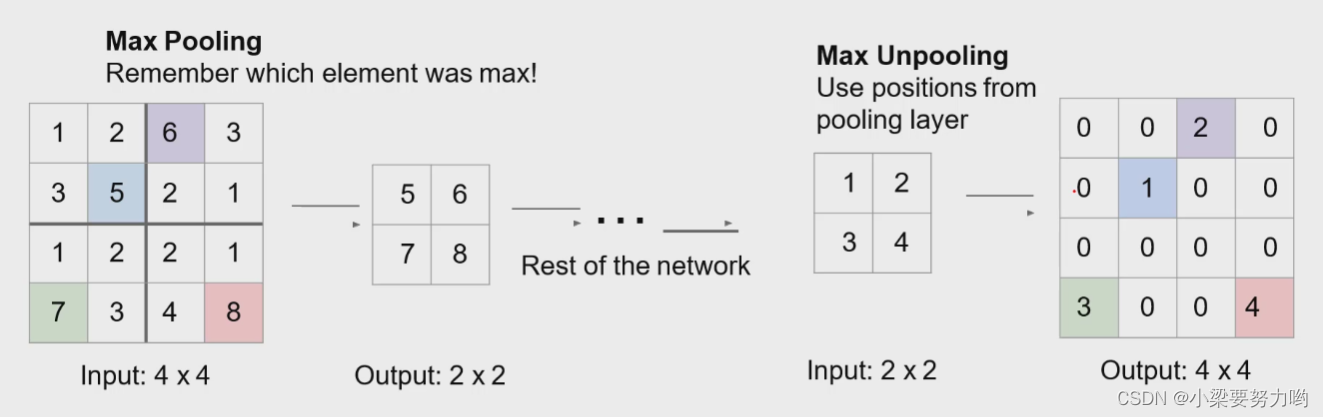

【CV-Learning】语义分割

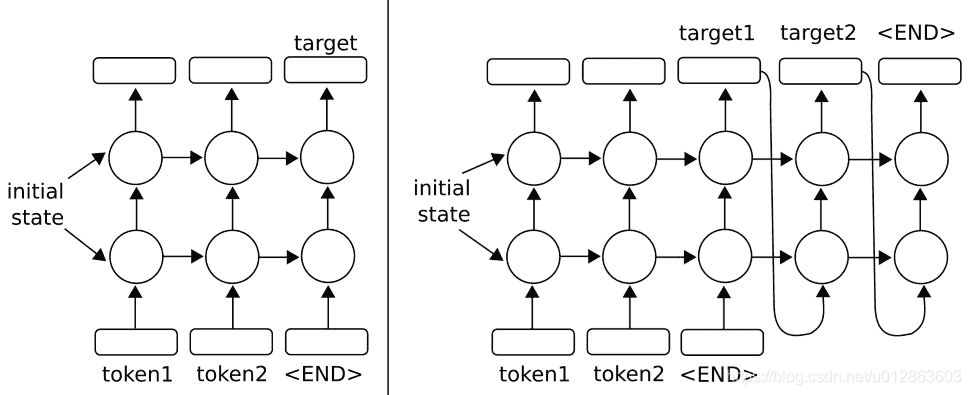

多层LSTM

【深度学习21天学习挑战赛】1、我的手写被模型成功识别——CNN实现mnist手写数字识别模型学习笔记

动手学深度学习__张量

语音驱动嘴型与面部动画生成的现状和趋势

剪映专业版字幕导出随笔

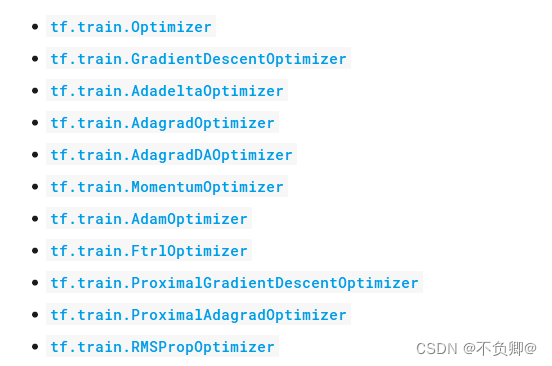

TensorFlow2学习笔记:7、优化器

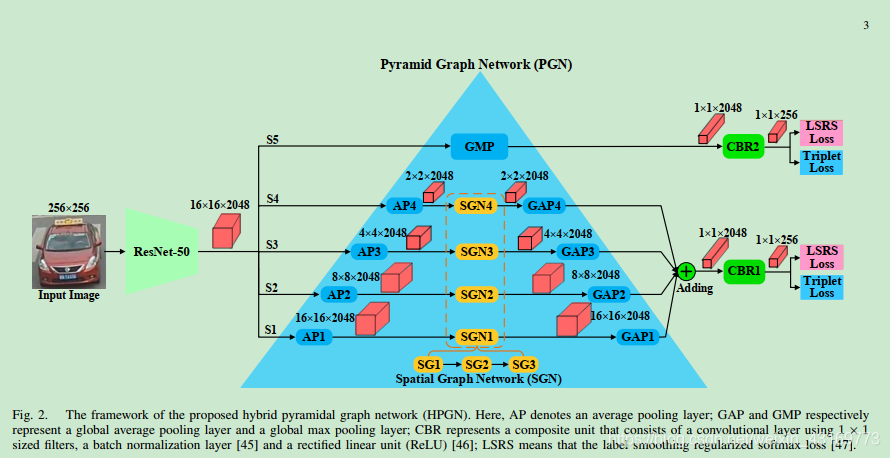

【论文阅读】Exploring Spatial Significance via Hybrid Pyramidal Graph Network for Vehicle Re-identificatio

随机推荐

AIDL communication between two APPs

动手学深度学习_多层感知机

Polynomial Regression (PolynomialFeatures)

Data reading in yolov3 (1)

ValueError: Expected 96 from C header, got 88 from PyObject

浅谈外挂常识和如何防御

SQL注入详解

PP-LiteSeg

ConnectionRefusedError: [Errno 111] Connection refused问题解决

2020-10-29

Android connects to mysql database using okhttp

周志华机器学习

(TensorFlow)——tf.variable_scope和tf.name_scope详解

PCL窗口操作

详解近端策略优化

光条中心提取方法总结(一)

线性回归简介01---API使用案例

Unity ML-agents 参数设置解明

卷积神经网络入门详解

如何用Pygame制作简单的贪吃蛇游戏

批量 batchsize 选择2的指数倍 与计算机内存相符

批量 batchsize 选择2的指数倍 与计算机内存相符