当前位置:网站首页>轻松入门自然语言处理系列 专题8 源码解读──基于HMM的结巴分词

轻松入门自然语言处理系列 专题8 源码解读──基于HMM的结巴分词

2022-08-02 15:05:00 【cutercorley】

前言

本文主要介绍了基于HMM的jieba分词,主要包含分词总览、源代码分析。

一、jiaba分词总览

中文不像英文单词之间以空格分割,而是以字为分界的,因此需要专门进行分词,分词也是一项基本的工作,同时分词的准确度直接影响到后续中文NLP任务的效果。中文分词存在着一些难点,包括歧义切分(多义组合、词之间的重叠)、新词,这些都会影响到分词的精度。最常用的中文分词工具是结巴分词,可参考https://github.com/fxsjy/jieba。

jieba分词的分词策略:

基于前缀词典实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图(DAG);

采用了动态规划

边栏推荐

猜你喜欢

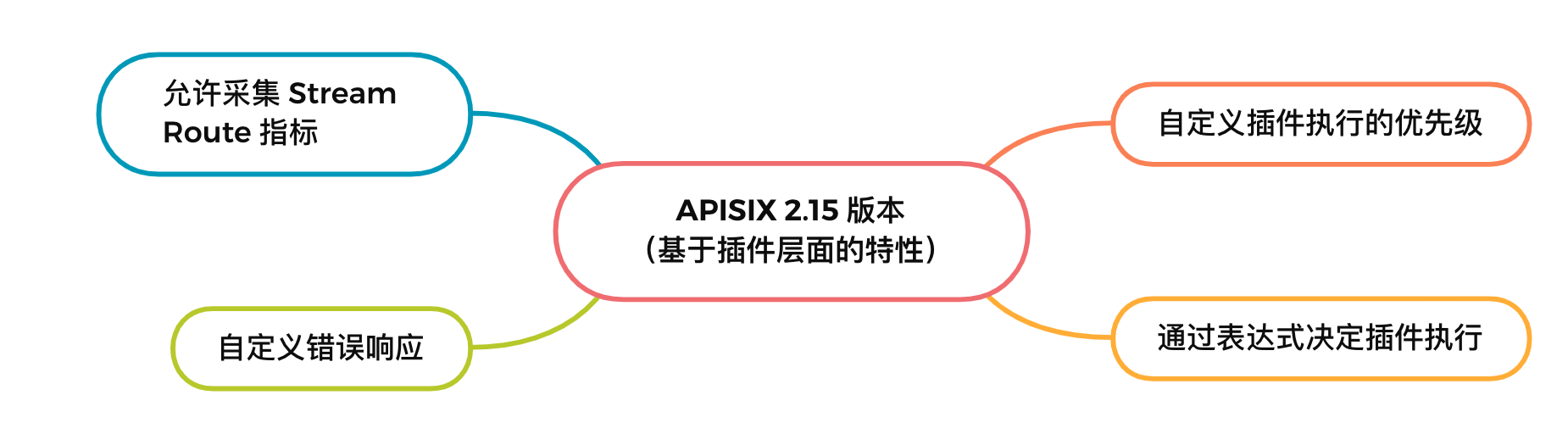

Apache APISIX 2.15 版本发布,为插件增加更多灵活性

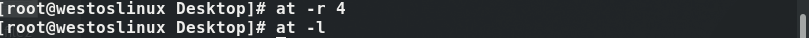

系统延时任务及定时任务

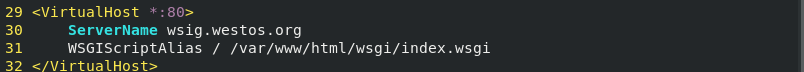

Apache的管理及web优化

【Leetcode字符串--字符串变换/进制的转换】HJ1.字符串最后一个单词的长度 HJ2.计算某字符出现次数 HJ30.字符串合并处理

OneFlow源码解析:Op、Kernel与解释器

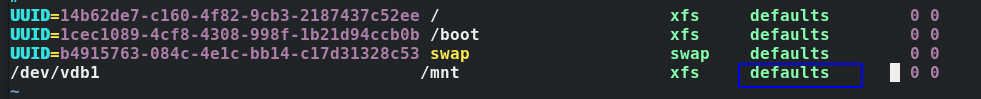

Basic management of system storage -- mounts, partitions, user quotas

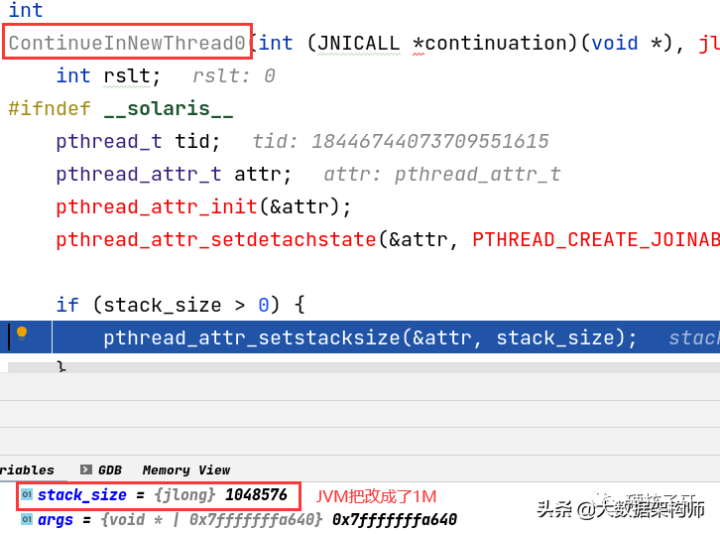

Brute-force cracking of the latest JVM interview questions of Meituan: unlimited execution

【无标题】

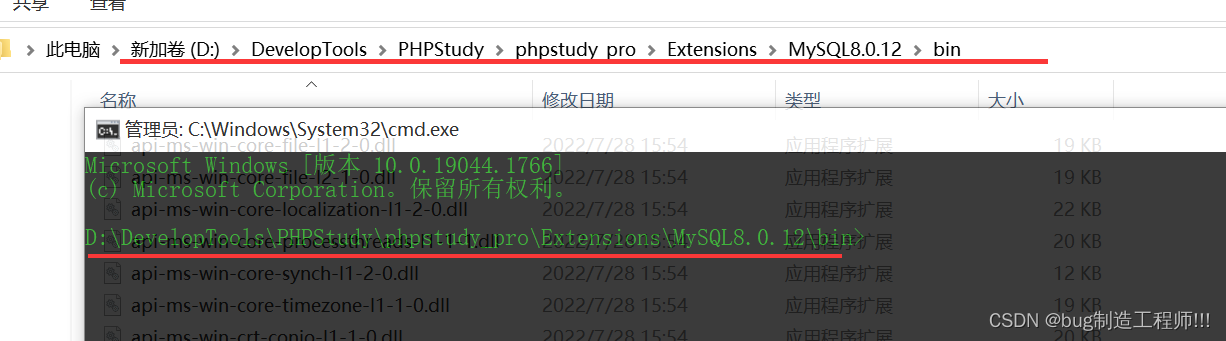

phpstudy实现命令行操作

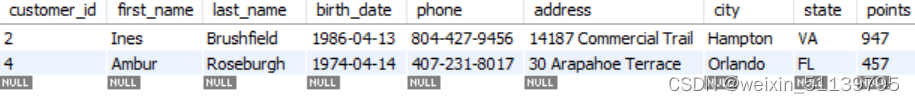

SQL学习笔记——REGEXP运算符

随机推荐

软件成分分析:华为云重磅发布开源软件治理服务

MySQL查询

【Untitled】

UnicodeEncodeError: 'gbk' codec can't encode character '\u2022' in position 178: illegal multibyte s

Qt | 关于 Qt Creator 打开项目编译不过的问题

Sql文件导入数据库-保姆级教程

面试了个阿里P7大佬,他让我见识到什么才是“精通高并发与调优”

PAT甲级 1145 哈希 - 平均查找时间

c语言实现排雷

PAT Class A 1078 Hash

HDU1561 树形背包dp+边界优化 0ms过题

华为研究院19级研究员几年心得,终成趣谈网络协议文档,附大牛讲解

OneFlow源码解析:Op、Kernel与解释器

How to use PHP to implement lexical analyzer and custom language

MySQL 行级锁(行锁、临键锁、间隙锁)

Basic management of mysql database in Linux system

PAT serie a 1137 final grades

How to check the WeChat applet server domain name and modify it

PAT甲级 1019 普通回文数

Qt | 鼠标事件和滚轮事件 QMouseEvent、QWheelEvent