当前位置:网站首页>Meta Learning 简述

Meta Learning 简述

2022-07-02 06:26:00 【MezereonXP】

Meta Learning 简述

先来回顾一下,传统的机器学习或者说深度学习的流程:

- 确定训练和测试数据集

- 确定模型结构

- 初始化模型参数(通常是一些惯用的随机分布)

- 初始化优化器类型和参数

- 进行训练,直到收敛

Meta Learning的目的是去学习一些在步骤2,3,4的参数,我们称之为元知识(meta- knowledge)

不妨对其进行形式化

假设数据集为 D = { ( x 1 , y 1 ) , . . . , ( x N , y N ) } D = \{(x_1,y_1),...,(x_N,y_N)\} D={ (x1,y1),...,(xN,yN)} 其中 x i x_i xi 是输入, y i y_i yi 是输出标签

我们的目的是得到一个预测模型 y ^ = f ( x ; θ ) \hat{y} = f(x;\theta) y^=f(x;θ) , 其中 θ \theta θ 表示模型的参数, x x x 为输入同时 y ^ \hat{y} y^ 是预测的输出

优化的形式为:

θ ∗ = arg min θ L ( D ; θ , ω ) \theta^*=\arg \min_{\theta} \mathcal{L}(D;\theta,\omega) θ∗=argθminL(D;θ,ω)

其中的 ω \omega ω 就是元知识,包括:

- 优化器类型

- 模型结构

- 模型参数的初始分布

- …

我们会对已有的数据集 D D D 进行任务划分,切分成多个任务集合,每一个任务集合包括一个训练集合以及一个测试集合,其形式为:

D s o u r c e = { ( D s o u r c e t r a i n , D s o u r c e v a l ) ( i ) } i = 1 M D_{source} = \{(D^{train}_{source},D^{val}_{source})^{(i)}\}_{i=1}^{M} Dsource={ (Dsourcetrain,Dsourceval)(i)}i=1M

优化目标为:

ω ∗ = arg max ω log p ( ω ∣ D s o u r c e ) \omega^* = \arg \max_{\omega} \log p(\omega|D_{source}) ω∗=argωmaxlogp(ω∣Dsource)

也就是在我们切分的多个任务集合中,找到一组配置(也就是元知识),使其对于这些任务来说最优。

一般称这个步骤为元训练(meta-training)

找到 ω ∗ \omega^* ω∗ 之后,便可以应用到一个目标任务数据集 D t a r g e t = { ( D t a r g e t t r a i n , D t a r g e t v a l ) } D_{target} = \{(D_{target}^{train}, D_{target}^{val})\} Dtarget={ (Dtargettrain,Dtargetval)}

在这上面进行传统的训练,也就是找到一个最优的模型参数 θ ∗ \theta^* θ∗

θ ∗ = arg max θ log p ( θ ∣ ω ∗ , D t a r g e t t r a i n ) \theta^* = \arg\max_{\theta}\log p(\theta|\omega^*, D_{target}^{train}) θ∗=argθmaxlogp(θ∣ω∗,Dtargettrain)

这个步骤称之为元测试(meta-testing)

边栏推荐

- iOD及Detectron2搭建过程问题记录

- Latex formula normal and italic

- 【FastDepth】《FastDepth:Fast Monocular Depth Estimation on Embedded Systems》

- Execution of procedures

- 【BiSeNet】《BiSeNet:Bilateral Segmentation Network for Real-time Semantic Segmentation》

- 机器学习理论学习:感知机

- Faster-ILOD、maskrcnn_ Benchmark trains its own VOC data set and problem summary

- 【雙目視覺】雙目矯正

- Machine learning theory learning: perceptron

- Faster-ILOD、maskrcnn_benchmark训练coco数据集及问题汇总

猜你喜欢

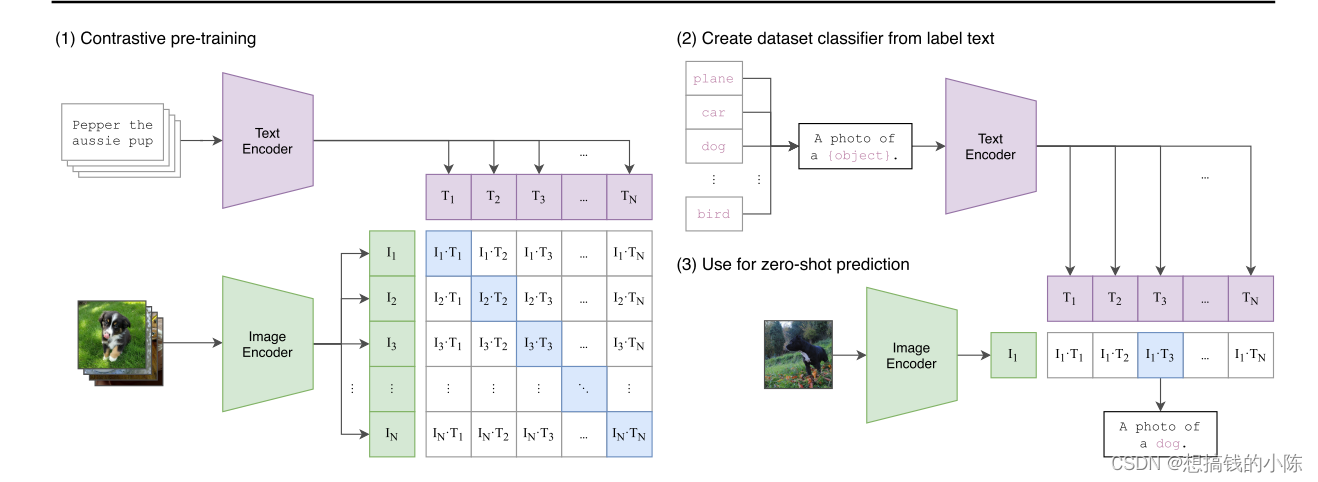

【多模态】CLIP模型

Faster-ILOD、maskrcnn_ Benchmark trains its own VOC data set and problem summary

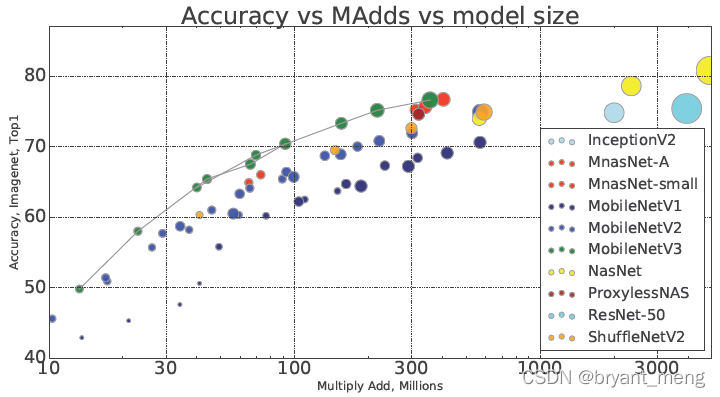

【MobileNet V3】《Searching for MobileNetV3》

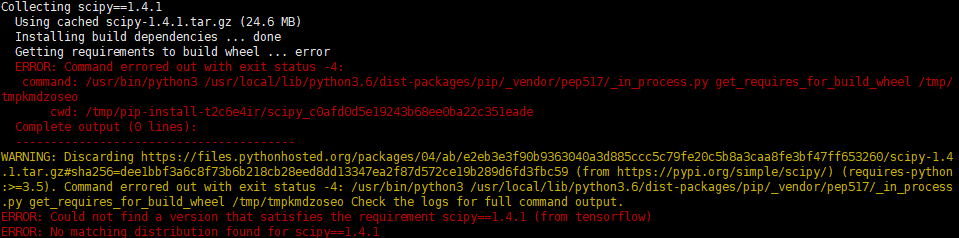

jetson nano安装tensorflow踩坑记录(scipy1.4.1)

How do vision transformer work?【论文解读】

【Batch】learning notes

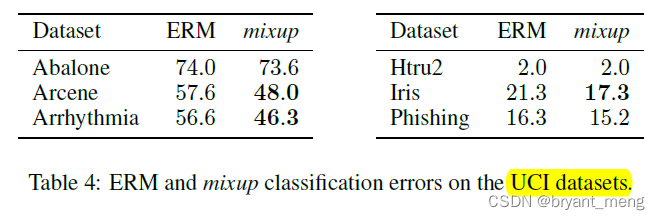

【Mixup】《Mixup:Beyond Empirical Risk Minimization》

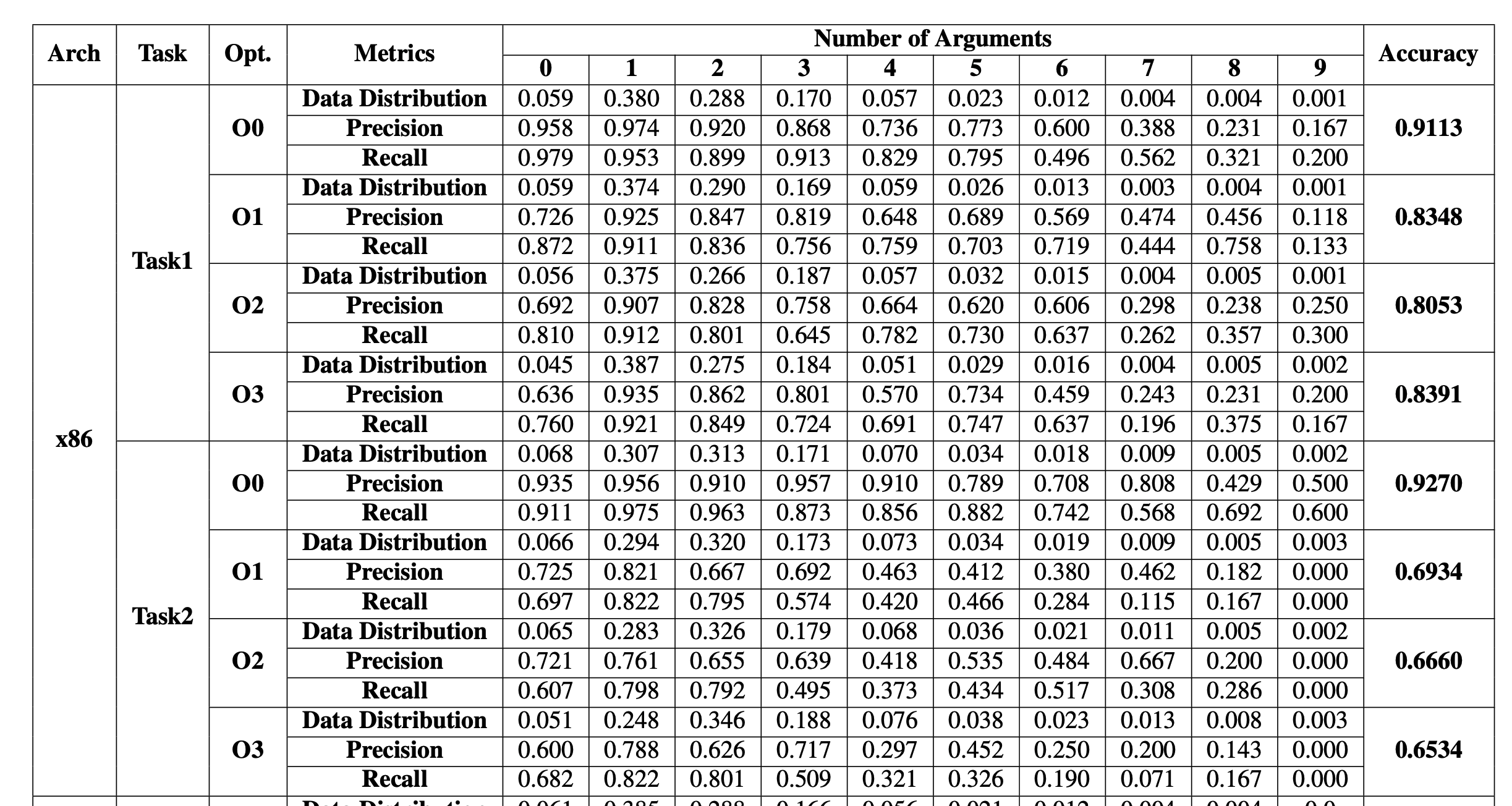

EKLAVYA -- 利用神经网络推断二进制文件中函数的参数

mmdetection训练自己的数据集--CVAT标注文件导出coco格式及相关操作

【Wing Loss】《Wing Loss for Robust Facial Landmark Localisation with Convolutional Neural Networks》

随机推荐

Win10+vs2017+denseflow compilation

What if the laptop can't search the wireless network signal

基于pytorch的YOLOv5单张图片检测实现

【FastDepth】《FastDepth:Fast Monocular Depth Estimation on Embedded Systems》

Two dimensional array de duplication in PHP

win10+vs2017+denseflow编译

【MobileNet V3】《Searching for MobileNetV3》

ABM thesis translation

【Hide-and-Seek】《Hide-and-Seek: A Data Augmentation Technique for Weakly-Supervised Localization xxx》

Replace convolution with full connection layer -- repmlp

The hystrix dashboard reported an error hystrix Stream is not in the allowed list of proxy host names solution

ModuleNotFoundError: No module named ‘pytest‘

【学习笔记】反向误差传播之数值微分

jetson nano安装tensorflow踩坑记录(scipy1.4.1)

CPU register

【Batch】learning notes

What if a new window always pops up when opening a folder on a laptop

[binocular vision] binocular correction

Memory model of program

【Cascade FPD】《Deep Convolutional Network Cascade for Facial Point Detection》